Исправляем ошибку при майнинге Ethereum на GeForce 1050

Все кто занимается добычей криптовалюты, рано или поздно сталкиваются с определенными проблемами в работе оборудования. Часто, решаются они быстро, а в большинстве случаев, вовсе проходят сами, после автоматического обновления ПО.

Сегодня же, поговорим о ошибке «CUDA error», а если быть точнее, то о том, как её победить. Я лично столкнулся с подобной проблемой, по-этому знаю о чем говорю. Не буду мучить вас предысториями о том, как у меня все начиналось и как я от этого страдал — это лишнее. Давайте сразу приступим к сути вопроса и его решению.

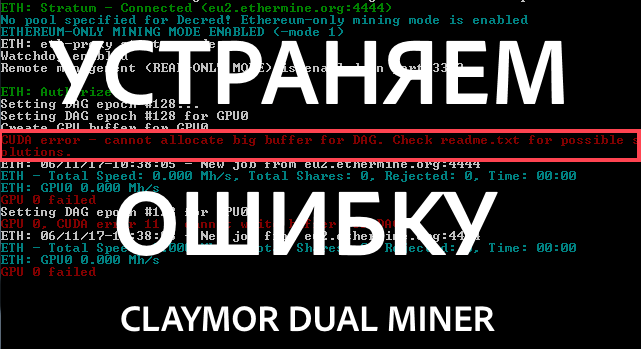

Если вы занимаетесь добычей Ethereum (эфириума), и у вас возникает такая ошибка (ниже выложу скрин), значит мой метод решения именно для вас:

Решение ошибки CUDA error

Шаг 1. На рабочем столе находим «Мой компьютер» нажимаем на него правой кнопкой, и выбираем последний пункт «Свойства»

Шаг 2. Идем по пути: «Дополнительные параметры системы» — «Дополнительно» — «Параметры» — опять «Дополнительно»

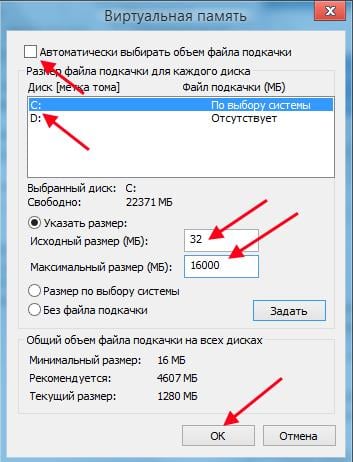

Шаг 3. Нажимаем кнопку «Изменить» возле надписи «Виртуальная память»

Шаг 4. Вводим нужную цифру (напомним, что она не должна быть ниже 16 000 Мб)

Собственно все. После таких манипуляций, мой риг сново ожил, а майнинг вернулся на прежний уровень дохода. Для тех кто не понял, что нужно делать, ниже оставлю видео, как это выглядит у меня, а там уже разберетесь. Собственно вот, как и обещал!

[creativ_media type=»youtube» url=»www.youtube.com/watch?v=Y-F-VcsUUpI»]

Не знаю, поможет ли вам этот способ, но мне помог. На самом деле, ошибки связанные с файлом подкачки, довольно таки частые, а данный метод поможет их решить. Всем хорошего майнинга и меньше ошибок при добыче крипты!

CUDA error — cannot allocate big buffer for DAG как исправить

Майнингом криптовалют не пытаются заниматься только самые ленивые. Результаты этой работы зависят от вычислительных мощностей компьютера, в частности видеокарты. Каждый день компьютер должен находить все новые данные в виде хэша. Но в некоторых случаях пользователи сталкиваются с ошибкой CUDA error – cannot allocate big buffer for DAG. Как её исправить, вы узнаете из этой статьи.

Подробнее об ошибке

Ошибка не обязательно происходит при майнинге. Пользователи могут столкнуться с ней и при работе с графикой. Особенно часто она встречается тем, кто работает с видео редакторами. Преимущественно появляется на ОС Windows 10. Рассмотрим их решения более подробно и определим несколько методов её устранения.

Для чего нужен файл DAG

DAG — это определенный блок данных, который используется при поиске элементов блокчейна в сети. Он построен на алгоритме Dagger Hashimoto. Добываемая валюта — Ethereum (Эфириум). Но есть и другие монеты в этом алгоритме. Например, Whale, Ubiq, Pegas, Dubaicoin, Musicoin, Soil и другие. Когда пользователь запускает сам майнер, DAG должен загрузиться в память. Более точный его размер — 1200 Мб. Со временем он способен увеличиваться в размере. Этот феномен называется смена эпох.

Каждой смене таких эпох соответствует свой размер файла. Количество занимаемой памяти DAG-файлом вы можете узнать по адресу: https://investoon.com/tools/dag_size. Здесь вы сможете узнать размер файла для всех монет на алгоритме Ethash. Смена каждой эпохи происходит примерно 1 раз в 10 дней.

Впервые проблемы с файлом DAG появились еще в 2016 году зимой. После смены нескольких десятков эпох, размер увеличился до 1.7 Гб. Использование данного алгоритма на видеокартах с 2 Гб видео памяти стало невозможным. Но в некоторых ситуациях проблему все же можно было решить.

Способы устранения ошибки

Проблема встречается в Windows потому, что операционная система требует для резерва около 750 Мб видеопамяти. При обычных операциях в видео процессоре эта память не занимается. Но со временем роста размера файла DAG, возникает ошибка CUDA error – cannot allocate big buffer for DAG.

Данная ошибка появляется все чаще на устройствах с видеокартой, которая имеет встроенную видеопамять — 2Гб. Файл DAG, который упоминается в тексте ошибки, требует от системы сплошного буфера. Этот буфер должен иметь размер чуть более 1 Гб. И вроде бы должно хватить видеопамяти, но система упорно выдает ошибку. Некоторым пользователям удается исправить эту проблему в Windows при помощи ввода нескольких команд. Прочитайте также эту статью. Она может быть полезной. Иногда получается устранить при помощи только одной — setx GPU_MAX_ALLOC_PERCENT 100.

Другие способы устранить ошибку

Если предыдущими методами решить проблему с видеокартой не получилось, попробуем увеличить файл подкачки Windows. В некоторых случаях эта рекомендация должна её решить.

Закройте окна и попытайтесь запустить майнер. Если вы пытаетесь на одной видеокарте майнить разными программами, попробуйте оставить только одну. Также попробуйте более новую Claymore Dual Miner 11.6. В этой версии разработчики решили проблемы, связанные с видеопамятью и рядом версий устройств. Найти данное ПО можно на странице https://www.dualminer.ru/. Также предпочтительно использовать для него операционную систему Windows 7. В ней пользователи намного реже сталкиваются с подобными ошибками.

А если у вас есть опыт использования ОС Linux — это будет для вас лучшим вариантом. Она уже настроена и готова работать с Claymore Dual Miner. Но работа и установка на этой ОС отличается более сложным процессом. Для этих задач Linux имеет ряд преимуществ. Главное — до 20% экономии электроэнергии при майнинге. Для больших ферм это немаловажно. В Linux достаточно редко встречается ошибка CUDA error — cannot allocate big buffer for DAG.

PhoenixMiner 5.4c

У меня видеокарта GTX 1060 3 ГБ пытаясь запустить PhoenixMiner 5.4c с порта 7100 или 7200 выдает ошибку а 7008 работает в чем проблема?

Какую ошибку выдает? Может памяти не выделяет в нужном количестве?

У меня, когда подключаюсь на 7100 пишет занято 2.59гб, поэтому 3гб должно быть достаточно, может система резервирует под чтото?

Запуская в майнере появляются эти данные и повторяются раз за разом.

CUDA error in CudaProgram.cu:388 : out of memory (2)

GPU1 initMiner error: out of memory

Fatal error detected. Restarting.

CUDA version: 11.0, CUDA runtime: 8.0

No OpenCL platforms found

Available GPUs for mining:

GPU1: GeForce GTX 1060 3GB (pcie 1), CUDA cap. 6.1, 3 GB VRAM, 9 CUs

Nvidia driver version: 461.40

Eth: the pool list contains 1 pool (1 from command-line)

Eth: primary pool: ltcraft.ru:7100

Starting GPU mining

GPU1: set auto fan: 65C target temp (min fan 30%, max fan 100%)

Eth: Connecting to ethash pool ltcraft.ru:7100 (proto: EthProxy)

Listening for CDM remote manager at port 3333 in read-only mode

Eth: Connected to ethash pool ltcraft.ru:7100 (185.31.161.248)

Eth: New job #62869729 from ltcraft.ru:7100; diff: 4000MH

GPU1: Starting up. (0)

GPU1: Generating etchash light cache for epoch #201

Light cache generated in 2.1 s (19.2 MB/s)

GPU1: Allocating DAG (2.59) GB; good for epoch up to #203

CUDA error in CudaProgram.cu:388 : out of memory (2)

GPU1: CUDA memory: 3.00 GB total, 2.43 GB free

GPU1 initMiner error: out of memory

Fatal error detected. Restarting.

Eth speed: 0.000 MH/s, shares: 0/0/0, time: 0:00

Означает, что для работы надо 2.59 гб видеопамяти.

Означает, что свободно 2.43Гб, получается памяти не хватает, если освободить немного памяти около 200 мегабайт, то ошибка пропадет. Нужно для теста завершить работу ненужных программ и проверить сколько освободилось видеопамяти.

и желтым выскакивает error 31

GPU: unable to set straps: error 31

you have to run PhoenixMiner as administrator to set straps

Самый эффективный и долгосрочный способ это перейти на Linux операционные системы, например, HiveOS, которые потребляют минимум видеопамяти. Такое кардинальное решение позволит владельца видеокарт с 4Gb памяти (GTX1050ti и RX480/RX580) оставаться в майнинге Ethereum до конца 2020 года.

Второй способ это установить Windows 7 или Windows 8, вместо десятки. Но этот переход выиграет Вам гораздо меньше времени и при этом Вы получите множество проблем с совместимостью и производительностью видеокарт в майнинге.

Третий вариант это остаться на Windows 10, но нужно выполнить несколько действий, которые увеличат время работы на эфире еще на 6-7 месяцев.

setx GPU_FORCE_64BIT_PTR 0

setx GPU_MAX_HEAP_SIZE 100

setx GPU_USE_SYNC_OBJECTS 1

setx GPU_MAX_ALLOC_PERCENT 100

setx GPU_SINGLE_ALLOC_PERCENT 100

Выполнив все эти рекомендации Вы продлите майнинг Ethereum с помощью видеокарт Geforce GTX1050Ti 4Gb на Windows 10 как минимум еще на пол года.

Подпишись на наш Telegram канал @cryptoage и Вконтакте, узнавай новости про криптовалюты первым.

Общайся с криптоэнтузиастами и майнерами в Telegram чате @CryptoChat

How to avoid «CUDA out of memory» in PyTorch

I think it’s a pretty common message for PyTorch users with low GPU memory:

I want to research object detection algorithms for my coursework. And many deep learning architectures require a large capacity of GPU-memory, so my machine can’t train those models. I tried to process an image by loading each layer to GPU and then loading it back:

But it doesn’t seem to be very effective. I’m wondering is there any tips and tricks to train large deep learning models while using little GPU memory. Thanks in advance!

Edit: I’m a beginner in deep learning. Apologize if it’s a dummy question:)

11 Answers 11

provides a good alternative for clearing the occupied cuda memory and we can also manually clear the not in use variables by using,

But still after using these commands, the error might appear again because pytorch doesn’t actually clears the memory instead clears the reference to the memory occupied by the variables. So reducing the batch_size after restarting the kernel and finding the optimum batch_size is the best possible option (but sometimes not a very feasible one).

Another way to get a deeper insight into the alloaction of memory in gpu is to use:

wherein, both the arguments are optional. This gives a readable summary of memory allocation and allows you to figure the reason of CUDA running out of memory and restart the kernel to avoid the error from happening again (Just like I did in my case).

Passing the data iteratively might help but changing the size of layers of your network or breaking them down would also prove effective (as sometimes the model also occupies a significant memory for example, while doing transfer learning).