прикладная статистика для машинного обучения

Прикладная статистика в машинном обучении 20/21

Содержание

О курсе

Курс читается для студентов 3-го курса в 1-2 модулях.

Полезные ссылки

Боевой листок

Лекции

[10 сентября] Лекция 1: Метод максимального правдоподобия: точечные и интервальные оценки.

[17 сентября] Лекция 2: Тест отношения правдоподобия и тест Вальда.

[24 сентября] Лекция 3: Тест множителей Лагранжа и энтропия.

[1 октября] Лекция 4: EM-алгоритм.

[8 октября] Лекция 5: EM-алгоритм и Bootstrap.

[15 октября] Лекция 6: Регрессия и нормальное распределение.

[22 октября] Лекция 7: Распределение хи-квадрат и F-распределение. F-тест.

[29 октября] Лекция 8: Повтор про F-распределение, t-распределение.

[5 ноября] Лекция 9: Гетероскедастичность и бутстрэп

[13 ноября] Лекция 10: разбор задач из контрольной

[20 ноября] Лекция 11: Гостевая лекция: метрики, MDE, бутстрэп.

[27 ноября] Лекция 12: Байесовский подход

[4 декабря] Лекция 13: Байесовский подход: продолжение

[11 декабря] Лекция 14: Алгоритм Метрополиса-Гастингса

[18 декабря] Лекция 15:

Если что, все тех-конспекты и конспекты от руки, что указаны здесь, лежат в этой папке, поэтому если мы ошиблись со ссылками (а мы могли), то ищите нужный файл в ней

Семинары

Семинар 1: Метод максимального правдоподобия.

Семинар 2: Тесты LR, LM и Wald.

Семинар 3: Энтропия и дивергенция Кульбака-Лейблера.

Семинар 4: EM-алгоритм.

Семинар 5: EM-алгоритм и Bootstrap.

Семинар 6: Геометрия МНК.

Семинар 7: Распределения.

Семинар 8: Тестирование гипотез в линейной регрессии.

Семинар 9: Гетероскедастичность.

Семинар 10: Мультиколлинеарность. Отбор регрессоров.

Семинар 11: Эндогенность.

Семинар 12: Множественное тестирование. Байесовские методы.

Семинар 13: Байесовские методы.

Семинар 14: Байесовские методы.

Домашние задания

Домашнее задание 1. Метод максимального правдоподобия.

Дедлайн: 11.10.2020, 23:59 МСК

Домашнее задание 2. EM-алгоритм. Линейная регрессия.

Дедлайн: 01.12.2020, 23:59 МСК

Домашнее задание 3. Тестирование гипотез. Байесовский подход.

Дедлайн: 17.12.2020, 23:59 МСК

Бонусное домашнее задание

Дедлайн: 17.12.2020, 23:59 МСК

Задания для подготовки

Квиз 2. Дивергенция Кульбака-Лейблера. EM-алгоритм.

Квиз 3. Проверка гипотез в линейной модели. Гетероскедастичность.

Квиз 4. Тестирование гипотез. Байесовский подход.

Консультации

Отчётность по курсу и критерии оценки

Домашние задания

Домашние задания загружаются в личный репозиторий в GitHub Classroom.

Правила оформления решений находятся на первой странице каждого домашнего задания.

Контрольная работа

Контрольная работа состоится онлайн 7-го ноября с 18:00 до 21:00. В контрольную работу войдут задачи по темам лекций и семинаров.

Экзамен

Экзамен состоится онлайн 21 декабря с 13:00 до 16:00. По формату экзамен будет похож на контрольную работу. Вопрос об автоматах уточняется.

Написание пропущенных работ

19 декабря (время уточняется) можно будет:

Итоговая оценка за курс

Итоговая оценка за курс рассчитывается по следующей формуле: Итог = 0.3 × ДЗ + 0.3 × КР + 0.2 × К + 0.2 × Э, где

ДЗ — усреднённая оценка за все домашние задания,

КР — оценка за контрольную работу,

Э — оценка за экзамен,

К — усреднённая оценка за все квизы на семинарах.

Округление арифметическое, округляется только итоговая оценка.

Прикладная статистика в машинном обучении

Содержание

О курсе

Курс читается для студентов 3-го курса ПМИ ФКН ВШЭ в 1-2 модулях.

Лектор: Артемов Алексей Валерьевич

Полезные ссылки

Репозиторий с материалами на GitHub: TBD

Семинары

Дата выдачи/сдачи дз

Система оценок

Результирующая оценка по дисциплине рассчитывается по формуле

Накопленная оценка рассчитывается по формуле

Накопленная и итоговая оценки округляются арифметически.

Бонус: при верном решении всех задач в домашнем задании, студент получает два бонусных балла. Бонусные баллы можно будет конвертировать как плюс-баллы на экзамене. Бонусные баллы суммируются.

Студенту, получившему отличную накопленную оценку, данная оценка может быть выставлена в качестве итоговой при условии, что им набрано не менее 2 бонусных баллов.

Коллоквиум

Коллоквиум в письменной форме будет проведен в субботу 11.11.2017 в аудитории 509 четвертой парой 15.10-16.30 и будет включать темы:

Программа курса

1. Введение. Основные задачи и методы теории статистических выводов (1 лекция, 1 семинар) (проведена 09.09.2017)

Параметрические и непараметрические модели. Основные задачи: точечное оценивание, доверительные множества, тестирование гипотез, исследование зависимостей. Эмпирическая функция распределения. Статистические функционалы.

2. Параметрическое оценивание (2 лекции, 2 семинара) (первая часть проведена 09.09.2017)

Метод моментов. Метод максимального правдоподобия и его свойства. Дельта-метод. Случай векторного параметра. Параметрический бутстреп. Доверительное оценивание. Достаточная статистика. Экспоненциальное семейство распределений. EM-алгоритм.

3. Бутстреп (1 лекция, 1 семинар)

Моделирование Монте-Карло, бутстреп. Оценка дисперсии на основе бутстрепа. Оценка доверительных интервалов на основе бутстрепа. Метод складного ножа.

4. Проверка гипотез (2 лекции, 2 семинара)

Основные понятия теории проверки гипотез. Критерий Вальда. P-значение. Распределение хи-квадрат и критерий Пирсона. Критерий перестановок. Критерий на основе отношения правдоподобия. Множественные тесты. Критерий согласия. Критерий Неймана-Пирсона для случая двух простых гипотез, t-критерий.

5. Линейная и логистическая регрессия (2 лекции, 2 семинара)

Стандартная линейная регрессия. Метод оценивания на основе минимизации невязок/максимизации правдоподобия. Свойства оценок метода наименьших квадратов. Прогнозирование. Множественная регрессия. Выбор модели. AIC, BIC. Логистическая регрессия.

6. Непараметрическое оценивание сигналов (1 лекция, 1 семинар) (проведена 21.10.2017)

7. Нелинейные методы построения регрессионных зависимостей (1 лекция, 1 семинар) (проведена 11.11.2017)

Аддитивные модели. Аппроксимационные модели на основе параметрических словарей (сигмоидальные функции, гауссоподобные функции, и т.д.). Построение аппроксимационных моделей на основе параметрических словарей: методы инициализации структуры; методы оценки параметров, учитывающие структуру модели; методы адаптивной регуляризации в процесс оценки параметров модели.

8. Регрессионные модели на основе гауссовских процессов (1 лекция, 1 семинар) (проведена 25.11.2017)

9. Оценка чувствительности модели (1 лекция, 1 семинар)

Введение, начальные условия, области применения. Постановка задачи оценки глобальной чувствительности модели. Обзор методов оценки чувствительности модели в случае выборки данных. Обзор методов оценки чувствительности модели в случае черного ящика. Выделение параметров, которые сильнее всего влияют на уровень радиоактивных изотопов в воде (Level E test case). Обзор теоретических основ метода оценки чувствительности модели на основе индексов Соболя.

10. Методы планирования экспериментов (Design of Experiments) (1 лекция, 1 семинар) (проведена 16.12.2017)

Space-filling DoE. Планирование экспериментов для линейных регрессионных моделей.

11. Снижение размерности многомерных данных (1 лекция, 1 семинар)

Снижение размерности в суррогатном моделировании. Постановка задачи снижения размерности. Обзор линейных методов снижения размерности (метод главных компонент, целенаправленное проектирование и т.п.). Обзор локальных и нелинейных методов снижения размерности (метод нелинейных главных компонент, метод локального линейного вложения и т.п.). Новые постановки задач снижения размерности. Аппроксимация многомерных зависимостей как решение задачи снижения размерности.

Статистика в Data Science — исчерпывающий гид для амбициозных практиков ML

В преддверии старта нового потока курса «Machine Learning Pro + Deep Learning» представляем вашему вниманию пост, который смело можно класть в закладки, — гид по статистике для амбициозных практиков машинного обучения. От ответа на вопрос, что такое статистика, до весьма подробных списков понятий, которые нужно усвоить, чтобы овладеть используемой в работе с проектами ML статистикой. Кроме того, в посте вы найдёте рекомендации литературы.

В современном сверхсвязанном мире данные генерируются и потребляются невиданными ранее темпами. И, как бы нам ни нравилась эта «сверхпроводимость данных», она провоцирует злоупотребления. Дата-сайентисты должны быть обучены использованию статистических методов не только для интерпретации цифр, но и для выявления таких злоупотреблений и защиты людей от введения в заблуждение. Немногие специалисты по статистике имеют формальную подготовку. Хороших книг и курсов, которые обучают статистическим методам с точки зрения науки о данных, немного. В этом посте я пролью свет на следующие вопросы:

Что такое статистика?

Статистика — это набор математических методов и инструментов, позволяющих ответить на важные вопросы о данных. Она делится на две категории:

Статистика в машинном обучении

В основе машинного обучения лежит статистика. Невозможно решить реальные проблемы с помощью машинного обучения, если вы не обладаете хорошим знанием основ статистики.

Конечно, имеются некоторые факторы, затрудняющие обучение статистике. Я говорю о математических уравнениях, греческой нотации и тщательно выверенных понятиях, затрудняющих развитие интереса к предмету. Можно решить эти проблемы с помощью простых и ясных объяснений, учебных пособий с соответствующим темпом и практических занятий — решения проблем с помощью прикладных методов статистики. От исследовательского анализа данных до разработки экспериментов для проверки гипотез статистика играет ключевую роль в решении проблем во всех основных отраслях и областях.

Тот, кто хочет развить глубокое понимание машинного обучения, должен узнать, как статистические методы формируют основу алгоритмов регрессии и классификации, как статистика позволяет учиться на основе данных и как она помогает извлекать смысл из немаркированных данных.

Зачем вам осваивать статистику?

Каждая организация стремится стать управляемой данными. Вот почему мы наблюдаем такой рост спроса на дата-сайентистов и аналитиков. Сегодня, чтобы решить проблемы, ответить на вопросы и наметить стратегию, нужно разобраться в данных. К счастью, статистика предлагает набор инструментов для получения этих знаний.

От данных к знаниям

Сами по себе сырые наблюдения — это просто данные. Чтобы трансформировать наблюдения в имеющие смысл идеи, применяется описательная статистика. Затем возможно применить логическую статистику, чтобы изучить небольшие выборки данных и дать схему с выводами для экстраполяции результатов на всю совокупность данных.

Статистика помогает ответить на вопросы, подобные этим

Статистика и проекты по машинному обучению

Почти каждый состоит из перечисленных ниже задач. И статистика играет в той или иной форме центральную роль во всех этих задачах. Ниже примеры:

Уточнение постановки проблемы

Наиболее важной частью прогностического моделирования является фактическое определение проблемы, дающее реальную цель, к которой мы должны стремиться. Это помогает определить тип проблемы, с которой мы имеем дело (то есть регрессия это или классификация), а также помогает в определении структуры и типов входных, выходных данных и метрик с учетом поставленной задачи. Но подстановка проблем не всегда проста. Если вы новичок в машинном обучении, она может потребовать значительного изучения наблюдений в вашей области. Два основных понятия, которые необходимо освоить здесь — это экспериментальный анализ данных (EDA) и добыча данных (Data Mining).

Первоначальное исследование данных

Исследование данных включает в себя получение глубокого понимания как распределения переменных, так и отношений между переменными в ваших данных.

Отчасти знание домена помогает овладеть определённым типом переменных. Тем не менее как эксперты, так и новички в этой области извлекают пользу из реальной работы с реальными наблюдениями в домене. Важные связанные с этим понятия в статистике сводятся к изучению описательной статистики и визуализации данных.

Очистка данных

Часто точки данных, собранные из эксперимента или хранилища данных, являются нетронутыми. Данные могли быть подвергнуты процессам или манипуляциям, которые повредили их целостность. Это еще больше влияет на последующие процессы или использующие такие данные модели. Распространённые примеры — пропущенные значения, повреждение данных, ошибки в данных (из-за плохого датчика), а также не приведённые к единой форме данные (наблюдения с разными масштабами). Если вы хотите освоить методы очистки, изучите выявление отклонений и вменение отсутствующих значений.

Подготовка данных и настройка конвейера преобразования

Если данные содержат ошибки и несоответствия, часто нельзя применять их в моделировании. Во-первых, данным, возможно, придётся пройти через набор преобразований, чтобы изменить форму или структуру и сделать их более подходящими для определённой вами задачи, или используемых алгоритмов обучения. Затем можно разработать конвейер таких преобразований, который будет применяться к данным для получения последовательных и совместимых входных данных для модели. Вы должны овладеть такими понятиями, как методы выборки данных и отбора признаков, преобразование данных, их масштабирование и кодирование.

Выбор и оценка модели

Ключевым шагом в решении прогностической проблемы являются выбор и оценка метода обучения. Оценочная статистика поможет вам оценить прогнозы модели на данных, которые модель не видела.

Проектирование экспериментов — это подраздел статистики, который управляет процессом выбора и оценки модели. Он требует хорошего понимания проверки статистических гипотез и оценочной статистики.

Тонкая настройка модели

Почти в каждом алгоритме машинного обучения имеется набор гиперпараметров, которые позволяют настроить метод обучения под выбранную вами постановку задачи. Эта гиперпараметрическая настройка часто носит эмпирический, но не аналитический характер. Для оценки влияния различных настроек гиперпараметра на производительность модели требуются большие наборы экспериментов.

Статистика: учебный план для практиков

Хорошая учебная программа по статистике для практиков должна охватывать не только множество методов и инструментов, о которых я только что писал. Она также должна охватывать и изучать наиболее часто встречающиеся проблемы в отрасли. Ниже приведён список широко используемых навыков, которые вам нужно освоить, чтобы пройти собеседование на должность дата-сайентиста и ML и устроиться на работу в этой области.

Основные навыки в статистике

Важные понятия статистики

Практические советы по обучению

Большинство университетов разработали учебные программы курсов по статистике, чтобы проверить способность студента справляться с трудностями. Они просто проверяют, могут ли учащиеся решать уравнения, определять терминологию и идентифицировать графики, выводящие уравнения, вместо того, чтобы сосредотачиваться на применении этих методов для решения реальных задач. Однако увлеченные специалисты-практики должны следовать пошаговому процессу изучения и реализации статистических методов по различным проблемам с использованием исполняемого кода Python. Рассмотрим два основных подхода к изучению статистики немного глубже.

Нисходящий подход

Допустим, вас попросят провести эксперимент для проверки эффективности двух версий продукта. Эта функция призвана повысить вовлечённость пользователей в работу онлайн-портала. С помощью подхода «сверху вниз» вы сначала узнаете больше о проблеме. Затем, как только цель станет ясной, вы сможете научиться применять соответствующие статистические методы. Это поддерживает ваше участие и предлагает лучший практический опыт обучения.

Восходящий метод

Такой подход позволяет большинству университетов и онлайн-курсов преподавать статистику. Он сосредоточена на изучении теоретических понятий с математической нотацией, истории понятия и способах применения. Для таких людей, как я, склонных терять интерес к теоретическому обучению, это неправильный способ изучения прикладной статистики. Он делает обучение слишком обобщённым, отсутствие какой-либо прямой связи с решением проблемы делает изучаемый объект сухим и депрессивным. Вероятно, вы уже поняли, я рекомендую нисходящий подход к изучению статистики. Давайте посмотрим на некоторые специфические ресурсы, которые я рекомендую, чтобы вы начали изучение статистики правильно.

Ресурсы для обучения

7 базовых статистических понятий, необходимых дата-сайентисту

Даже если вы хорошо программируете, но слабо ориентируетесь в статистике, вероятность выжить в Data Science очень низка.

У статистики есть несколько различных определений. Одно из самых простых и точных — это «наука о сборе и классификации цифровых данных». А если добавить к нему немного о программировании и машинном обучении, то получится неплохое описание основ Data Science.

В самом деле, в Data Science трудно найти область, где нет статистики в том или ином виде. Она нужна для:

Мы выбрали семь базовых концепций, без которых в Data Science точно не обойтись. К счастью, они не слишком сложны.

С некоторых пор утверждает, что он data scientist. В предыдущих сезонах выдавал себя за математика, звукорежиссёра, радиоведущего, переводчика, писателя. Кандидат наук, но не точных. Бесстрашно пишет о Data Science и программировании на Python.

1. Меры описательной статистики

Ключевые показатели, применяемые в описательной статистике (их ещё называют мерами или, если точнее, мерами центральной тенденции), — это:

Посмотрите это небольшое видео о среднем, медиане и моде на сайте Академии Хана — образовательного ресурса, который славится доходчивыми объяснениями. Там всё просто, на понятном русском языке.

Кроме трёх перечисленных, есть и другие статистические показатели — например, меры рассеяния. Главная из них — дисперсия, о ней ниже. Все они нужны, чтобы понять, какие перед нами данные и о чём именно они рассказывают.

2. Распределение

Внешняя форма данных, выраженная в мерах описательной статистики, даёт нам информацию об их характере. Это как в жизни: по фигуре, походке и одежде человека обычно можно догадаться о его поле, возрасте и даже профессии. В случае числовых данных мы догадываемся о распределении.

Термин пришёл из теории вероятностей, которая рассматривает любое событие в мире как имеющее ту или иную вероятность. Однородные события хоть и происходят с разной вероятностью, но подчиняются распределению, которое «раздаёт» им эти вероятности.

В Data Science распределение понимается обобщённо: это закон соответствия одной величины другой. Оно подсказывает нам, какой именно процесс может скрываться за данными, и то, насколько эти данные полны. Чуть подробнее об этом в нашей статье про математику для джунов.

Возможно, вы уже слышали про колокол нормального распределения, или гауссиану: она описывает процессы, где результат является суммой многих случайных величин, каждая из которых слабо зависит от другой и вносит сравнительно небольшой вклад.

Величина ошибок измерения в физике, длина когтей, зубов и шерсти в биологии, объёмы речных стоков в гидрологии — все эти показатели имеют нормальное распределение. Это, пожалуй, самое распространённое в природе и не только в природе распределение, поэтому оно и названо нормальным.

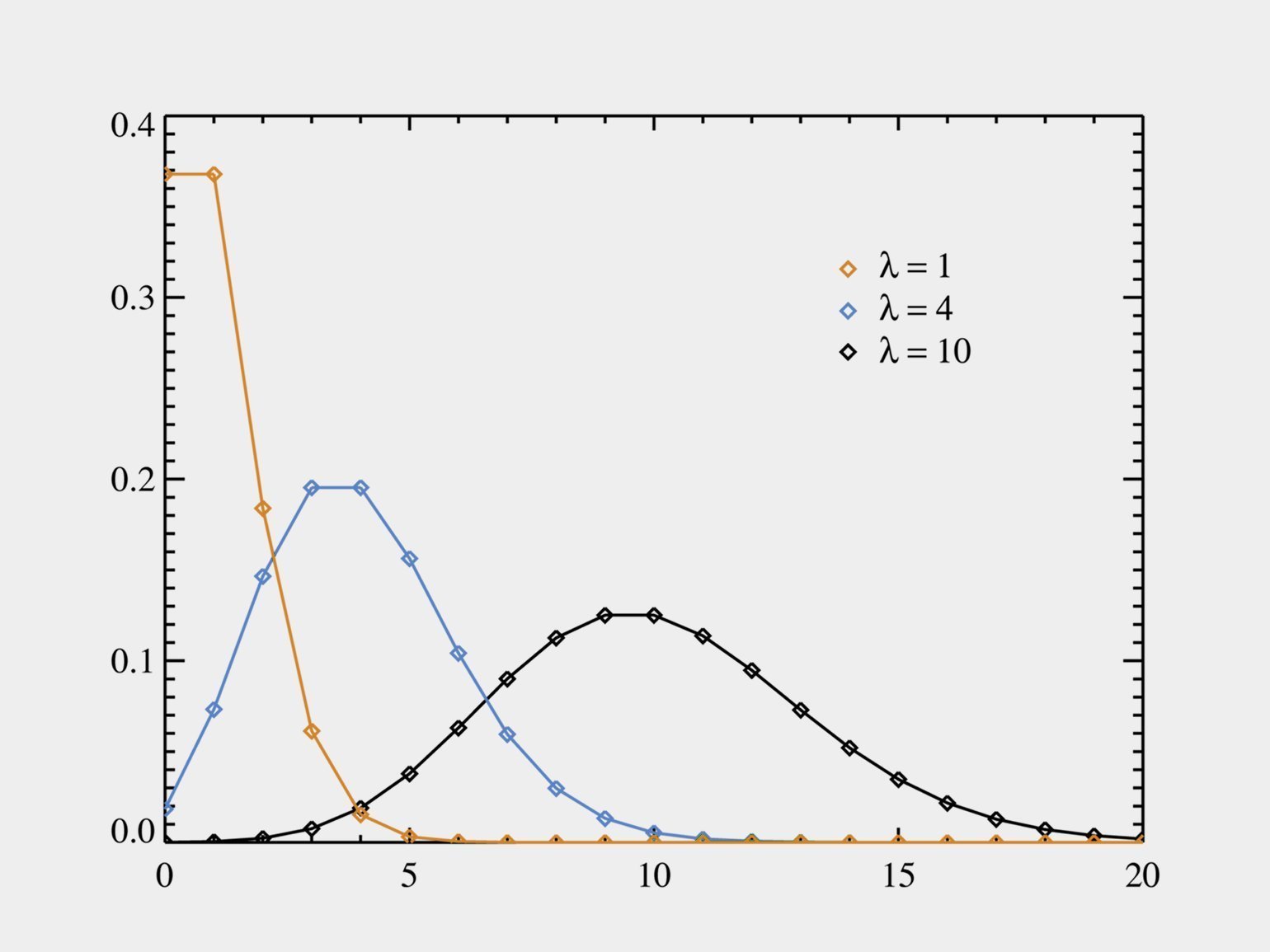

Распределение Пуассона тоже часто встречается в работе дата-сайентистов и аналитиков: это число событий за какой-то промежуток времени — при условии, что события независимы друг от друга и имеют некоторый порог интенсивности.

Это и число посетителей в торговом центре, и количество голов, забитых футбольной командой, и скорость роста колонии бактерий.

Существуют и другие распределения, в том числе довольно экзотические: Вигнера, Вейбулла, Коши. Они встречаются намного реже или преимущественно в каких-то специальных областях вроде квантовой физики. Тем не менее дата-сайентисту нужно знать графики, параметры и названия основных распределений, благо их не так много.

3. Семплирование

Предположим, вам требуется решить важную задачу: выяснить среднюю ширину морды домашних котов нашей страны. Прямой способ, то есть измерение всех домашних питомцев, невозможен по ряду объективных причин. Придётся ограничиться выборкой — взять какое-то число животных, измерить морды именно им и сделать выводы по итогам только этих исследований.

Но тут сразу же возникают вопросы:

Семплирование — это группа статистических методов и приёмов, отвечающих на эти вопросы. С помощью семплирования мы формируем нашу выборку так, чтобы она наилучшим образом отражала свойства генеральной совокупности — то есть свойства всех котов страны.

Иными словами, вы не можете измерить N первых попавшихся котов и обобщить результат для остальных. Выборка должна хорошо «сидеть» во всей популяции кошек, чтобы можно было делать обоснованные выводы. Такую выборку называют релевантной.

Кстати, статистика и котики — близнецы-братья. После выхода одноимённой книги Владимира Савельева мы говорим «статистика», а подразумеваем «котики», и наоборот. И смело рекомендуем эту книгу всем, кто дочитал до этого места.

В Data Science методы семплирования применяются при разработке, подготовке и оценке датасетов, чтобы они одновременно и были упорядоченными, и соответствовали реальности.

4. Смещение

Прочитайте нашу статью о создании простой модели машинного обучения. Она предсказывает город, в который вероятнее всего поедет турист, на основании его возраста, пола, места жительства, дохода и транспортных предпочтений. Такая рекомендательная система на минималках.

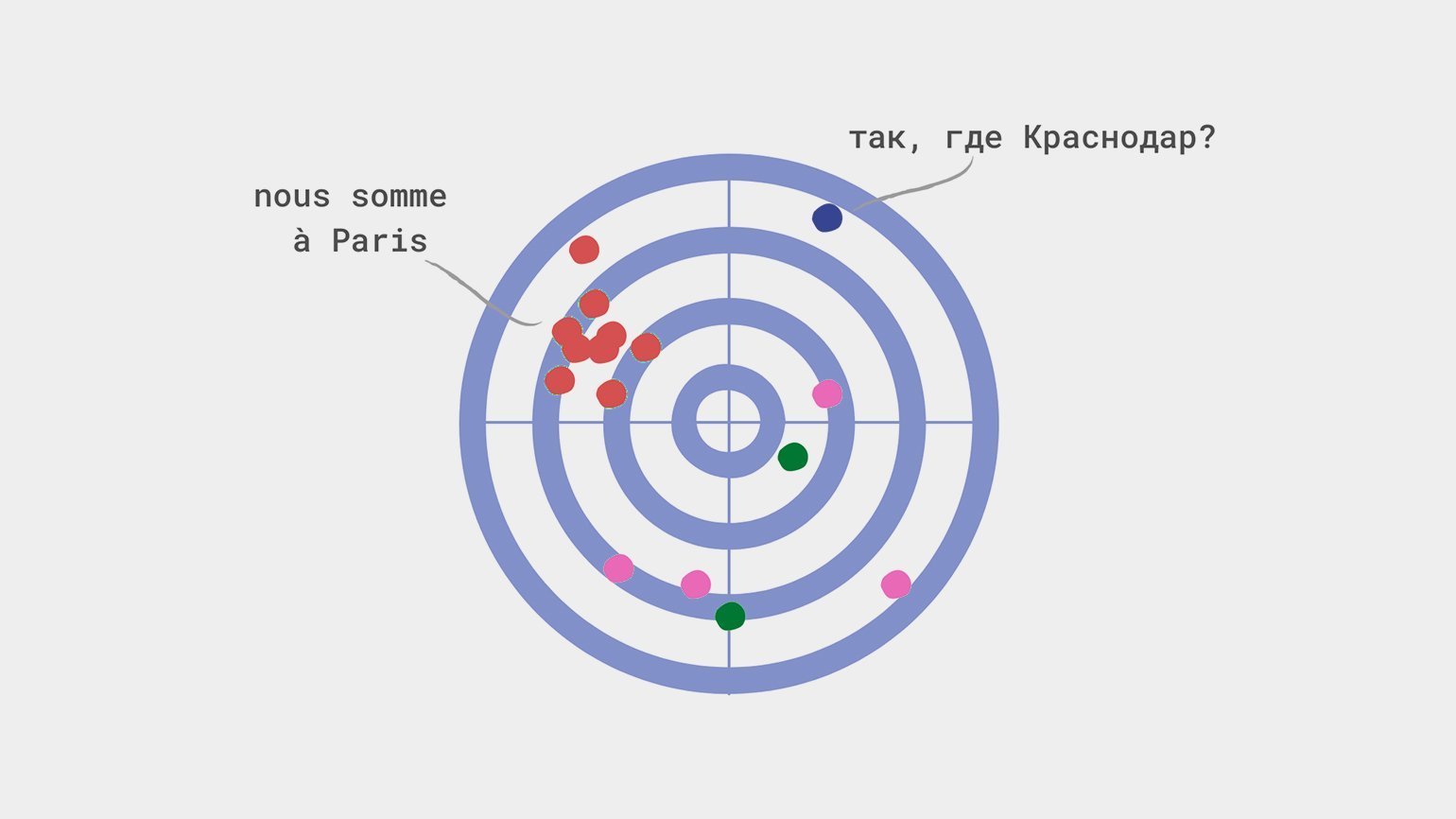

Смещение происходит, когда модель недооценивает или переоценивает какой-либо параметр. Представим, что модель из статьи выше отправляет всех краснодарцев в Париж — независимо от их дохода, предпочтений и других параметров. В этом случае мы скажем, что модель переоценивает значение параметра «Город проживания».

Чаще всего причиной смещения являются:

Когда мы неверно собираем данные, говорят о систематической ошибке отбора. Например, в прошлом веке многие считали, что во Вселенной больше голубых галактик, — впечатление возникало потому, что плёнка была более чувствительна к голубой части спектра.

Другая ошибка — ошибка меткого стрелка — происходит, когда мы вольно или невольно отбираем в выборку только схожие между собой данные, то есть фактически рисуем мишень вокруг места, куда попадём.

Причин, вызывающих смещение, так много, что Марк Твен заметил: «Существует три вида лжи: ложь, наглая ложь и статистика». Например:

Эти и другие ошибки смещения трудно выявить статистическими методами, поэтому нужно стараться избежать их до того, как вы начнёте сбор данных.

Если пить «Боржоми» уже поздно (датасет уже сформирован), обязательно спросите себя: «Не смещены ли мои данные?» — а они наверняка смещены, «Куда и почему они смещены?» и «Можно ли с этим жить?»

5. Дисперсия

Дисперсия — это величина, показывающая, как именно и насколько сильно разбросаны значения — например, предсказания модели машинного обучения или доход за рассматриваемый период. За точку, относительно которой эти значения разбросаны, берут истинное значение, целевую переменную или математическое ожидание, которое вычисляется теоретически и заранее.

Часто в качестве матожидания выступает обычное среднее арифметическое. Например, математическое ожидание количества очков при броске игрального кубика равно среднему арифметическому очков на всех гранях:

(1 + 2 + 3 + 4 + 5 + 6) / 6 = 21/6 = 3,5

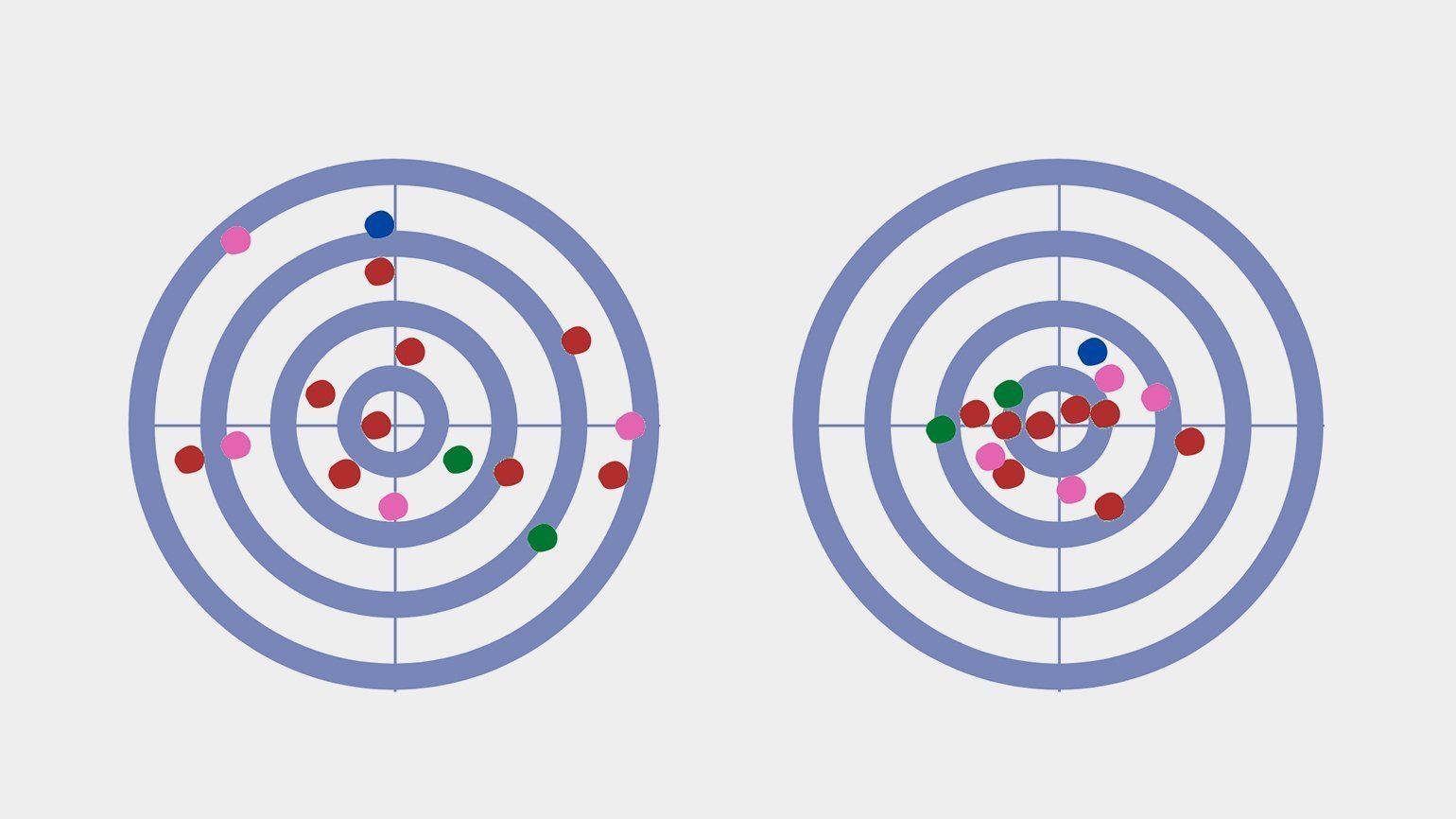

Представьте себе тир, стрелка и мишень. Снайпер стреляет в стандартный круг, где попадание в центр даёт 10 баллов, в зависимости от удаления от центра количество баллов снижается, а крайние области дают всего 1 балл. Каждый выстрел стрелка — это случайное целое значение от 1 до 10.

Изрешечённая пулями мишень — отличная иллюстрация распределения. Дисперсия здесь — величина, обратная кучности попаданий: хорошая кучность означает низкую дисперсию, и наоборот.

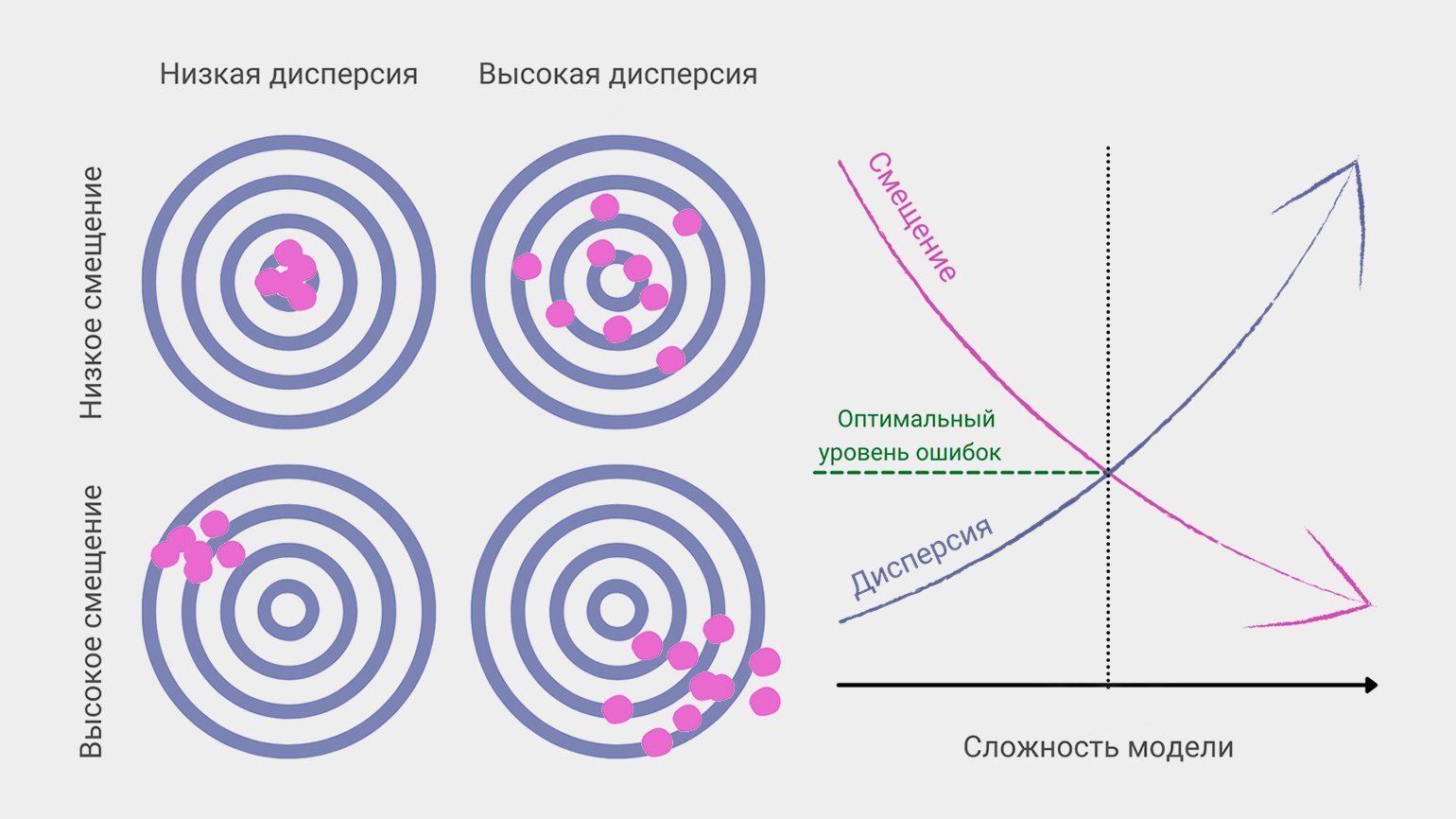

6. Дилемма (компромисс) смещения и дисперсии

Смещение и дисперсия вместе составляют итоговую ошибку предсказания модели машинного обучения. В идеальном мире и смещение маленькое, и дисперсия низкая. На практике это связано в дилемму: уменьшение одной из величин неизбежно приводит к росту другой.

Если не вдаваться в детали, обучение модели — это построение функции, график которой лучше всего ложится на точки из тренировочного набора данных.

Модель может нарисовать нам довольно сложную и заковыристую функцию, график, который хорошо охватывает все точки в тренировочных данных. Но если наложить этот график на новые точки (то есть дать функции новые данные), она сработает хуже — так и получается смещение.

С другой стороны, обучение на разных тренировочных наборах или даже разных датасетах с большой вероятностью даст разброс в предсказаниях, то есть высокую дисперсию.

Более сложные модели дают низкое смещение, но чувствительны к шуму и колебаниям в новых данных, поэтому их предсказания разбросаны. Если при обучении наш снайпер будет учитывать незначимые факторы (вроде цвета мишени или направления магнитного поля Земли), то в другом тире, с другой винтовкой или в другую погоду точность его стрельбы упадёт.

Простые модели, напротив, упускают важные параметры и «бьют кучно, но мимо». Как другой снайпер, не приученный обращать внимание на ветер и расстояние до мишени.

В процессе настройки модели машинного обучения дата-сайентист всегда ищет компромисс между смещением и дисперсией, чтобы уменьшить общую ошибку предсказания.

Кстати, эта дилемма встречается не только в статистике и машинном обучении, но и в обучении людей. В исследовании 2009 года утверждается, что люди используют эвристику «высокое смещение + низкая дисперсия»: мы заблуждаемся, зато очень уверенно.

Учтите это, если захотите сделать свой ИИ более похожим на человека.

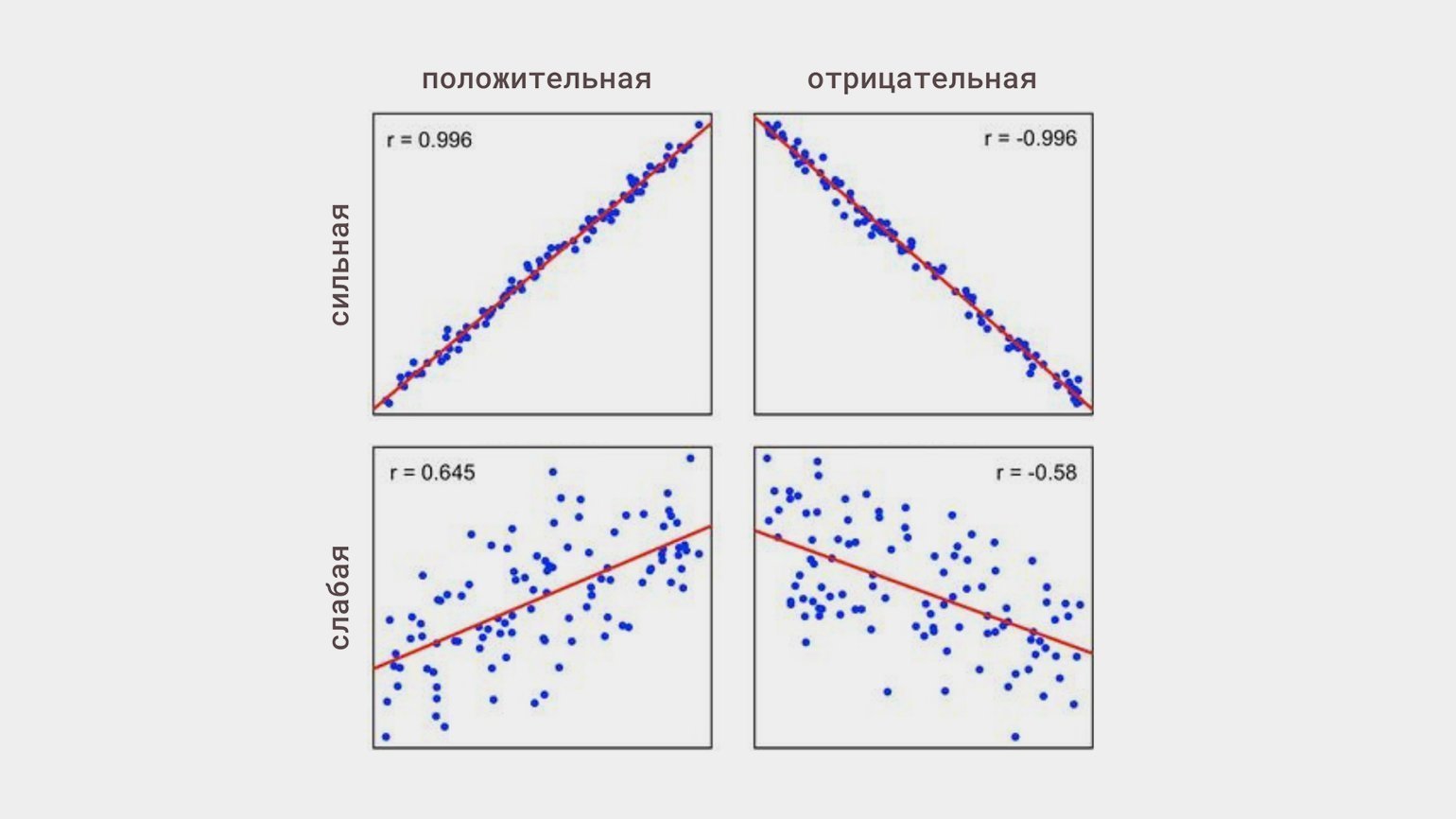

7. Корреляция

Когда изменения одной величины сопутствуют изменениям другой, говорят о корреляции. Главное, что необходимо о ней знать: корреляция не означает причинно-следственную связь.

Линейная корреляция — это когда изменения одной величины пропорциональны изменениям другой. Она может быть:

Статистическую связь между переменными исследуют с помощью корреляционного анализа. Его основная задача — оценить тесноту связи (это термин) между переменными, чтобы понять, какие переменные учитывать в модели, а какие нет.

И ещё раз, потому что действительно важно: корреляция ни в коем случае не означает причинно-следственную связь. Если два показателя скоррелированы, то далеко не факт, что они хоть как-то связаны.

Кстати, проект Spurious Correlations («Ложные корреляции») публикует графики корреляций между совершенно неожиданными статистическими показателями — например, количеством людей, утонувших в домашних бассейнах, и числом фильмов с участием Николаса Кейджа.

Имеет смысл время от времени заходить по этой ссылке с целью профилактики СПГС — синдрома поиска глубинной связи.

Заключение

Data Science — не просто комбинирование модных моделей в Jupyter-ноутбуке. Профессионалы в этой области глубоко понимают природу данных и то, как они могут помочь в принятии конкретных бизнес-решений.

Всё это изучалось в статистике задолго до того, как первый дата-сайентист набрал свой первый import pandas as pd. Статистика — фундамент всей современной науки о данных, включая машинное обучение, глубокие нейросети и даже искусственный интеллект.

В нашем курсе «Профессия Data Scientist» статистике уделено самое пристальное внимание. Вы не ударите в грязь лицом ни на тусовке статистиков, ни на настоящем DS-собеседовании. Приходите!