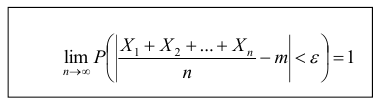

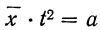

закон больших чисел утверждает что

Закон больших чисел

Взаимодействуя ежедневно в работе или учебе с цифрами и числами, многие из нас даже не подозревают о том, что существует очень интересный закон больших чисел, применяемый, например, в статистике, экономике и даже психолого-педагогических исследованиях. Он относится к теории вероятностей и говорит о том, что среднее арифметическое какой-либо большой выборки из фиксированного распределения близко к математическому ожиданию этого распределения.

Вы, наверное, заметили, что понять сущность этого закона непросто, особенно тем, кто не особо дружит с математикой. Исходя из этого, мы бы хотели рассказать о нем простым языком (насколько это возможно, конечно), чтобы каждый мог хотя бы примерно уяснить для себя, что это такое. Эти знания помогут вам лучше разобраться в некоторых математических закономерностях, стать более эрудированным и положительным образом повлиять на развитие мышления.

Понятия закона больших чисел и его трактовка

Помимо рассмотренного нами выше определения закона больших чисел в теории вероятностей, можно привести и его экономическое толкование. В этом случае он представляет собой принцип, согласно которому частоту финансовых потерь конкретного вида можно предсказать с высокой степенью достоверности тогда, когда наблюдается высокий уровень потерь подобных видов вообще.

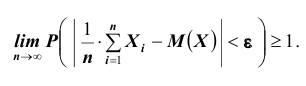

Помимо этого, в зависимости от уровня сходимости признаков можно выделить слабый и усиленный законы больших чисел. О слабом речь идет, когда сходимость существует по вероятности, а об усиленном – когда сходимость существует практически во всем.

Если интерпретировать несколько иначе, то следует сказать так: всегда можно найти такое конечное число испытаний, где с любой запрограммированной наперед вероятностью меньше единицы относительная частота появления какого-то события будет крайне мало отличаться от его вероятности.

Таким образом, общую суть закона больших чисел можно выразить так: результатом комплексного действия большого количества одинаковых и независимых случайных факторов будет такой результат, который не зависит от случая. А если говорить еще более простым языком, то в законе больших чисел количественные закономерности массовых явлений будут явно проявляться только при большом их числе (поэтому и называется закон законом больших чисел).

Отсюда можно сделать вывод, что сущность закона состоит в том, что в числах, которые получаются при массовом наблюдении, имеются некоторые правильности, обнаружить которые в небольшом количестве фактов невозможно.

Сущность закона больших чисел и его примеры

Закон больших чисел выражает наиболее общие закономерности случайного и необходимого. Когда случайные отклонения «гасят» друг друга, средние показатели, определенные для одной и той же структуры, приобретают форму типичных. Они отражают действия существенных и постоянных фактов в конкретных условиях времени и места.

Определенные посредством закона больших чисел закономерности сильны только тогда, когда представляют массовые тенденции, и они не могут быть законами для отдельных случаев. Так, вступает в силу принцип математической статистики, говорящий, что комплексное действие ряда случайных факторов способно стать причиной неслучайного результата. И наиболее яркий пример действия данного принципа – это сближение частоты наступления случайного события и его вероятности, когда возрастает количество испытаний.

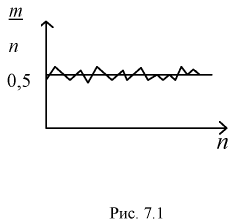

Давайте вспомним обычное бросание монетки. Теоретически орел и решка могут выпасть с одной и той же вероятностью. Это означает, что если, к примеру, бросить монетку 10 раз, 5 из них должна выпасть решка и 5 – орел. Но каждый знает, что так не происходит практически никогда, ведь соотношение частоты выпадения орла и решки может быть и 4 к 6, и 9 к 1, и 2 к 8 и т.д. Однако с увеличением количества подбрасываний монетки, например, до 100, вероятность того, что выпадет орел или решка, достигает 50%. Если же теоретически проводить бесконечное количество подобных опытов, вероятность выпадения монетки обеими сторонами всегда будет стремиться к 50%.

На то, как именно упадет монетка, влияет огромное число случайных факторов. Это и положение монетки на ладони, и сила, с которой совершается бросок, и высота падения, и его скорость и т.д. Но если опытов много, вне зависимости от того, как воздействуют факторы, всегда можно утверждать, что практическая вероятность близка к вероятности теоретической.

А вот еще один пример, который поможет понять сущность закона больших чисел: предположим, что нам нужно оценить уровень заработка людей в каком-то регионе. Если мы будем рассматривать 10 наблюдений, где 9 человек получают 20 тыс. рублей, а 1 человек – 500 тыс. рублей, среднее арифметическое составит 68 тыс. рублей, что, естественно, маловероятно. Но если мы возьмем в расчет 100 наблюдений, где 99 человек получают 20 тыс. рублей, а 1 человек – 500 тыс. рублей, то при расчете среднего арифметического получим 24,8 тыс. рублей, что уже ближе к реальному положению дел. Увеличивая число наблюдений, мы будем заставлять среднее значение стремиться к истинному показателю.

Именно по этой причине для применения закона больших чисел в первую очередь необходимо набрать статистический материал, чтобы получать правдивые результаты, изучая большое число наблюдений. Потому-то и удобно использовать этот закон, опять же, в статистике или социальной экономике.

Подведем итоги

Значение того, что закон больших чисел работает, сложно переоценить для любой области научного знания, и особенно для научных разработок в области теории статистики и методов статистического познания. Действие закона также обладает большим значением и для самих изучаемых объектов с их массовыми закономерностями. На законе больших чисел и принципе математической статистике основываются практически все методы статистического наблюдения.

Но, даже не беря во внимание науку и статистику как таковые, можно смело сделать вывод, что закон больших чисел – это не просто явление из области теории вероятностей, но феномен, с которым мы сталкиваемся практически каждый день в своей жизни.

Надеемся, теперь сущность закона больших чисел стала вам более понятна, и вы сможете легко и просто объяснить его кому-то другому. А если тема математики и теории вероятностей вам интересна в принципе, то рекомендуем почитать о числах Фибоначчи и парадоксе Монти Холла. Также познакомьтесь с приближенными вычислениями в жизненных ситуациях и самыми популярными числами. И, конечно же, обратите внимание на наш курс по когнитивистике, ведь, пройдя его, вы не только овладеете новыми техниками мышления, но и улучшите свои когнитивные способности в целом, в том числе и математические.

Закон больших чисел

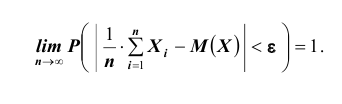

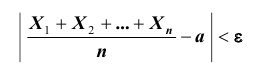

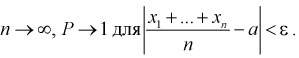

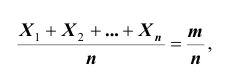

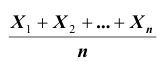

Зако́н больши́х чи́сел в теории вероятностей утверждает, что эмпирическое среднее (среднее арифметическое) достаточно большой конечной выборки из фиксированного распределения близко к теоретическому среднему (математическому ожиданию) этого распределения. В зависимости от вида сходимости различают слабый закон больших чисел, когда имеет место сходимость по вероятности, и усиленный закон больших чисел, когда имеет место сходимость почти всюду.

Всегда найдётся такое количество испытаний, при котором с любой заданной наперёд вероятностью относительная частота появления некоторого события будет сколь угодно мало отличаться от его вероятности.

Общий смысл закона больших чисел — совместное действие большого числа случайных факторов приводит к результату, почти не зависящему от случая.

На этом свойстве основаны методы оценки вероятности на основе анализа конечной выборки. Наглядным примером является прогноз результатов выборов на основе опроса выборки избирателей.

Содержание

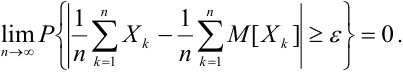

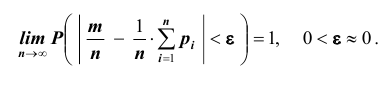

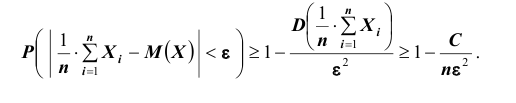

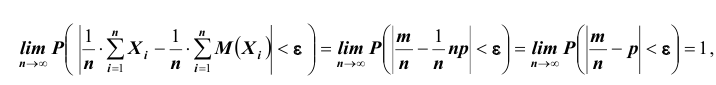

Слабый закон больших чисел

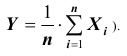

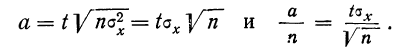

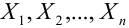

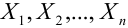

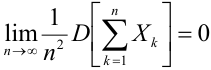

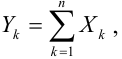

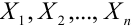

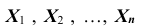

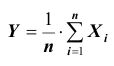

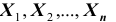

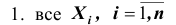

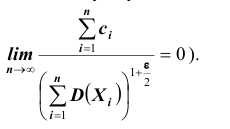

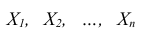

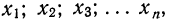

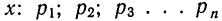

Пусть есть бесконечная последовательность (последовательное перечисление) одинаково распределённых и некоррелированных случайных величин

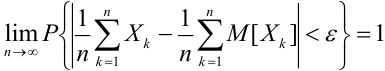

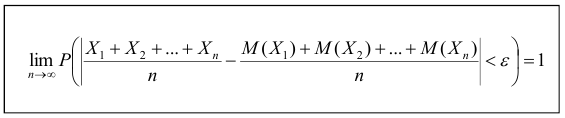

Тогда

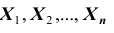

Усиленный закон больших чисел

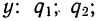

Пусть есть бесконечная последовательность независимых одинаково распределённых случайных величин

Тогда

См. также

Литература

Полезное

Смотреть что такое «Закон больших чисел» в других словарях:

ЗАКОН БОЛЬШИХ ЧИСЕЛ — (law of large numbers) В том случае, когда поведение отдельных представителей населения отличается большим своеобразием, поведение группы в среднем более предсказуемо, чем поведение любого ее члена. Тенденция, в соответствии с которой группы… … Экономический словарь

ЗАКОН БОЛЬШИХ ЧИСЕЛ — см. БОЛЬШИХ ЧИСЕЛ ЗАКОН. Antinazi. Энциклопедия социологии, 2009 … Энциклопедия социологии

Закон Больших Чисел — принцип, согласно которому количественные закономерности, присущие массовым общественным явлениям, наиболее явным образом проявляются при достаточно большом числе наблюдений. Единичные явления в большей степени подвержены воздействию случайных и… … Словарь бизнес-терминов

ЗАКОН БОЛЬШИХ ЧИСЕЛ — утверждает, что с вероятностью, близкой к единице, среднее арифметическое большого числа случайных величин примерно одного порядка будет мало отличаться от константы, равной среднему арифметическому из математических ожиданий этих величин. Разл.… … Геологическая энциклопедия

закон больших чисел — — [Я.Н.Лугинский, М.С.Фези Жилинская, Ю.С.Кабиров. Англо русский словарь по электротехнике и электроэнергетике, Москва, 1999 г.] Тематики электротехника, основные понятия EN law of averageslaw of large numbers … Справочник технического переводчика

закон больших чисел — didžiųjų skaičių dėsnis statusas T sritis fizika atitikmenys: angl. law of large numbers vok. Gesetz der großen Zahlen, n rus. закон больших чисел, m pranc. loi des grands nombres, f … Fizikos terminų žodynas

ЗАКОН БОЛЬШИХ ЧИСЕЛ — общий принцип, в силу к рого совместное действие случайных факторов приводит при нек рых весьма общих условиях к рез ту, почти не зависящему от случая. Сближение частоты наступления случайного события с его вероятностью при возрастании числа… … Российская социологическая энциклопедия

Закон больших чисел — закон, гласящий, что совокупное действие большого числа случайных факторов приводит, при некоторых весьма общих условиях, к результату, почти не зависящему от случая … Социология: словарь

ЗАКОН БОЛЬШИХ ЧИСЕЛ — принцип, по которому частота финансовых потерь определенного вида может быть предсказана с высокой точностью тогда, когда есть большое количество потерь аналогичных видов … Энциклопедический словарь экономики и права

Закон больших чисел и то, чем он не является

О законе больших чисел (збч) написано много (например, на английском, тут и тут, также [1]). В этом тексте я попробую рассказать о том, чем закон больших чисел не является – об ошибочном восприятии этого закона и потенциальных ловушках, спрятанных в математических формулировках.

Начнем с того, что же такое закон больших чисел. Неформально, это математическая теорема о том, что «вероятность отклонений среднего по выборке от математческого ожидания мала» и что «эта вероятность стремится к нулю при увеличении выборки». Совсем неформально, теорема утверждает, что с мы можем быть в достаточной степени уверены, что среднее по нашей выборке достаточно близко к «настоящему» среднему и таким образом хорошо его описывает. Разумеется, предполагается наличие традиционного статистического «багажа» — наши наблюдения из выборки должны описывать одно и то же явление, они должны быть независимы, и мысль о том, что есть некоторое «настоящее» распределение с «настоящим» средним, не должна вызывать у нас существенных сомнений.

При формулировке закона мы говорим «среднее по выборке», и все что может быть математически записано как такое среднее, попадает под действие закона. Например, доля событий в общей массе может быть записана как среднее, — нам достаточно записать наличие события как «1» и отсутствие как «0». В итоге среднее будет равно частоте и частота должна быть близка к теоретическому среднему. Именно поэтому по ожидаем, что доля «орлов» при подбрасывании идеальной монеты будет близка к ½.

Рассмотрим теперь ловушки и ошибочные представления об этом законе.

Во-первых, ЗБЧ не всегда верен. Это всего лишь математическая теорема с «входными данными» — предположениями. Если предположения неверны, то и закон не обязан выполняться. Например, это так если наблюдения зависимы, или если нет уверенности в том, что «настоящее» среднее существует и конечно, или если изучаемое явление меняется во времени и мы не можем утверждать, что мы наблюдаем одну и ту же величину. По правде говоря, в определенной степени ЗБЧ верен и в этих случаях, например, для слабокоррелированных наблюдений или даже в том случае когда наблюдаемая величина меняется во времени. Однако, для корректного приложения этого к непосредственной реальности нужен хорошо тренированный специалист-математик.

Во-вторых, кажется верным, что ЗБЧ утверждает «среднее по выборке близко к настоящему среднему». Однако, такое утверждаение остается не полным: надо обязательно добавлять «с высокой долей вероятности; и эта вероятность всегда меньше 100%».

В-третьих, хочется сформулировать ЗБЧ как «среднее по выборке сходится к настоящему среднему при неограниченном росте выборки». Однако, это неверно, потому что среднее по выборке вообще никуда не сходится, так как оно случайное и остается таковым для любого размера выборки. Например, даже если подбросить симметричную монету миллион раз, все равное есть шанс, что доля орлов будет далека от ½ или даже равна нулю. В определенном смысле, всегда есть шанс получить что-то необычное. Надо признать, однако, что наша интуиция все-таки подсказыает нам что ЗБЧ должен описывать какую-то сходимость, и так есть на самом деле. Только «сходится» не среднее, а «вероятность отклонения выборочного среднего от его истинного значения», и сходится к нулю. Так как эта идея интуитивно очень удобна («шансы увидеть что-то необычное стремятся к нулю»), матетматики придумали для этого особый тип сходимости – «сходимость по вероятности».

В-четвертых, ЗБЧ не говорит ничего о том, когда выборочное среднее можно считать достаточно близким к теоретическому. Закон больших чисел только постулирует существование определенного явления, он ничего не говорит о том, когда его можно использовать. Получается, на ключевой вопрос с точки зрения практики — «могу ли я использовать ЗБЧ для моей выборки размера n?», закон больших чисел не отвечает. Ответы на эти вопросы дают другие теоремы, например, Центральная Предельная Теорема. Она дает представление о том, в каких пределах выборочное среднее может отклоняться от своего истинного значения.

В заключение следует отметить центральную роль ЗБЧ в статистике и теории вероятностей. История этого закона началась тогда, когда ученые заметили, что частоты некоторых повторяющихся явлений стабилизируются и перестают существенно меняться, при условии многократного повторения опыта или наблюдения. Поразительным было то, что эта «стабилизация частот» наблюдалась для совершенно несвязаных явления – от бросания игральной кости до урожайности в сельском хозяйстве, указывая на возможное существование «закона природы». Интересно, что этот закон природы оказался частью математики, а не физики, химии или биологии, как обычно бывает с законами природы.

[1] Illustrating the Law of Large Numbers (and Confidence Intervals) Jeffrey D Blume & Richard M Royall

Закон больших чисел

ЗБЧ важен, поскольку он гарантирует устойчивость для средних значений некоторых случайных событий при достаточно длинной серии экспериментов.

Важно помнить, что закон применим только тогда, когда рассматривается большое количество испытаний.

Связанные понятия

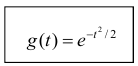

Центра́льные преде́льные теоре́мы (Ц. П. Т.) — класс теорем в теории вероятностей, утверждающих, что сумма достаточно большого количества слабо зависимых случайных величин, имеющих примерно одинаковые масштабы (ни одно из слагаемых не доминирует, не вносит в сумму определяющего вклада), имеет распределение, близкое к нормальному.

Упоминания в литературе

Связанные понятия (продолжение)

В теории вероятностей два случайных события называются независимыми, если наступление одного из них не изменяет вероятность наступления другого. Аналогично, две случайные величины называют независимыми, если известное значение одной из них не дает информации о другой.

Измери́мые функции представляют естественный класс функций, связывающих пространства с выделенными алгебрами множеств, в частности измеримыми пространствами.

В компле́ксном анализе вы́четом заданного объекта (функции, формы) называется объект (число, форма или когомологический класс формы), характеризующий локальные свойства заданного.

В теории вероятностей говорят, что событие почти достоверно или что оно произойдет почти наверняка, если это произойдет с вероятностью 1. Понятие является аналогом понятия «почти всюду» в теории меры. В то время, как во многих основных вероятностных экспериментах нет никакой разницы между «почти достоверно» и «достоверно», (то есть, событие произойдет совершенно точно), это различие важно в более сложных случаях, относящихся к случаям рассмотрения какой-либо бесконечности. Например, термин часто.

Конечная разность — математический термин, широко применяющийся в методах вычисления при интерполировании.

Содержание:

Закон больших чисел:

Теория вероятностей изучает закономерности, свойственные массовым случайным явлениям. Как и любая другая наука, теория вероятностей предназначена для того, чтобы возможно точнее предсказать результат того или иного явления или эксперимента. Если явление носит единичный характер, то теория вероятностей способна предсказать лишь вероятность исхода в весьма широких пределах. Закономерности проявляются только при большом числе случайных явлений, происходящих в однородных условиях.

Группа теорем, устанавливающих соответствие между теоретическими и экспериментальными характеристиками случайных величин и случайных событий при большом числе испытаний над ними, а также касающихся предельных законов распределения, объединяются под общим названием предельных теорем теории вероятностей.

Есть два типа предельных теорем: закон больших чисел и центральная предельная теорема.

Закон больших чисел, занимающий важнейшее место в теории вероятностей, является связующим звеном между теорией вероятностей как математической наукой и закономерностями случайных явлений при массовых наблюдениях над ними.

Закон играет очень важную роль в практических применениях теории вероятностей к явлениям природы и техническим процессам, связанным с массовым производством.

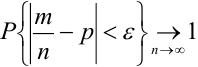

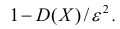

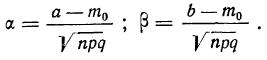

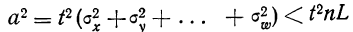

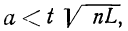

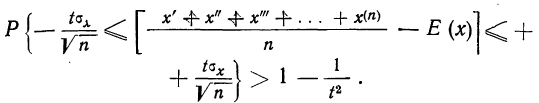

При неограниченном увеличении числа однородных независимых опытов частота события будет сколь угодно мало отличаться от вероятности события в отдельном опыте. Иначе, вероятность того, что отклонение относительной частоты

b) Теорема Чебышева.

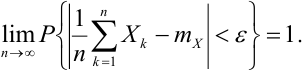

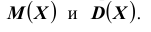

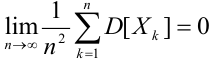

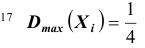

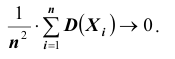

При неограниченном увеличении числа независимых испытаний среднее арифметическое наблюдаемых значений случайной величины, имеющей конечную дисперсию, сходится по вероятности к ее математическому ожиданию иначе, если

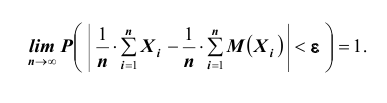

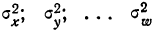

Теорема Чебышева (обобщенная). Если случайные величины в последовательности

с) Теорема Маркова, (закон больших чисел в общей формулировке)

Если дисперсии произвольных случайных величин в последовательности

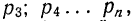

d) Теорема Пуассона.

При неограниченном увеличении числа независимых опытов в переменных условиях частота события А сходится по вероятности к среднему арифметическому его вероятностей

Замечание. Ни в одной из форм закона больших чисел мы не имеем дела с законами распределения случайных величин. Вопрос, связанный с отысканием предельного закона распределения суммы

Теорема Ляпунова (простейшая форма, когда

Если случайные величины

Замечание. Случайные величины

Определение закона больших чисел

Массовые явления и закон больших чисел:

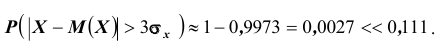

Огромный опыт, накопленный человечеством, учит нас, что явления, имеющие вероятность, весьма близкую к единице, почти обязательно происходят. Точно так же события, вероятность наступления которых очень мала (иными словами, очень близка к нулю), наступают очень редко. Это обстоятельство играет основную роль для всех практических выводов из теории вероятностей, так как указанный опытный факт даёт право в практической деятельности считать мало вероятные события практически невозможными, а события, происходящие с вероятностями, весьма близкими к единице, практически достоверными. При этом на вполне естественный вопрос, какова должна быть вероятность, чтобы мы могли событие считать практически невозможным (практически достоверным), однозначного ответа дать нельзя. И это понятно, так как в практической деятельности необходимо учитывать важность тех событий, с которыми приходится

иметь дело.

Так, например, если бы при измерении расстояния между двумя пунктами оказалось, что оно равно 5340м и ошибка этого измерения с вероятностью 0,02 равна или больше (или меньше) 20м, то мы можем пренебречь возможностью такой ошибки и считать что расстояние действительно равно 5340м. Таким образом, в данном примере мы считаем событие с вероятностью 0,02 практически несущественным (практически невозможным) и в своей практической деятельности его не учитываем. В то же время в других случаях пренебрегать вероятностями 0,02 и даже ещё меньшими нельзя. Так, если при строительстве большой гидроэлектростанции, требующей огромных материальных затрат и человеческого труда, выяснилось, что вероятность катастрофического паводка в рассматриваемых условиях равна 0,02, то эта вероятность будет сочтена большой и при проектировании станции она должна быть обязательно учтена, а не отброшена, как

это было сделано в предыдущем примере.

Таким образом, только требования практики могут нам подсказать критерии, согласно которым мы будем считать те или иные события практически невозможными или практически достоверными.

В то же время необходимо заметить, что любое событие, имеющее положительную вероятность, пусть даже близкую к нулю, может произойти. И если число испытаний, в каждом из которых оно может произойти с одной и той же вероятностью, очень велико, то вероятность хотя бы однократного его появления может стать сколь угодно близкой к единице. Это обстоятельство постоянно следует иметь в виду. Из сказанного понятно, что в практической деятельности, да и в общетеоретических задачах, большое значении имеют события с вероятностями близкими к единице или нулю. Отсюда становится ясным, что одной из основных задач теории вероятностей должно быть установление закономерностей, происходящих с вероятностями, близкими к единице; при этом особую роль должны играть закономерности, возникающие в результате наложения большого числа независимых или слабо зависимых случайных фактов.

Действительно, нельзя заранее уверенно предвидеть, какое из возможных значений примет случайная величина в итоге испытания; это зависит от многих случайных причин, учесть которые мы не в состоянии. Казалось бы, что поскольку о каждой случайной величине мы располагаем в этом смысле весьма скромными сведениями, то вряд ли можно установить закономерности поведения и суммы достаточно большого числа случайных величин. На самом деле это не так.

Оказывается, что при некоторых сравнительно широких условиях суммарное поведение достаточно большого числа случайных величин почти утрачивает случайный характер и становится закономерным.

Наличие связи между теоретическими и экспериментальными характеристиками случайных величин, проявляемой в большом числе опытов, позволяет предугадывать результаты массовых случайных явлений долей уверенности. Для практики очень важно знание условий, при выполнении которых совокупное действие очень многих случайных причин приводит к результату, почти не зависящему от случая, так как позволяет предвидеть ход явлений. Эти условия и указываются в ряде предельных теорем, одна группа которых объединена под общим названием «Закон больших чисел», другая же – под общим названием «Центральная предельная теорема».

Закон больших чисел состоит из теорем Чебышева и Бернулли (имеются и другие теоремы), в которых доказывается приближение при определённых условиях среднего арифметического случайных величин к некоторым случайным характеристикам. Теорема Чебышева является наиболее общим законом больших чисел, теорема Бернулли – простейшим.

В другой же группе предельных теорем, объединённых под общим названием «Центральная предельная теорема», устанавливается факт приближения при определённых условиях закона распределения суммы

по нормальному закону.

Таким образом, закон больших чисел и центральная теорема составляют две группы предельных теорем теории вероятностей, которые в совокупности позволяют вполне обоснованно осуществлять прогнозы в области случайных явлений, давая при этом оценку точности производимых прогнозов.

Теорема Чебышева

Для доказательства теоремы Чебышева (да и других теорем, в том числе) воспользуемся одноимённым неравенством. Неравенство Чебышева (как впрочем и теорема) справедливо как для дискретных, так и для непрерывных случайных величин. Мы ограничимся, например, доказательством неравенства для непрерывной случайной величины.

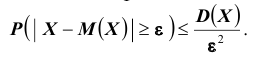

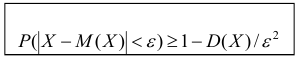

НЕРАВЕНСТВО Чебышева

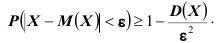

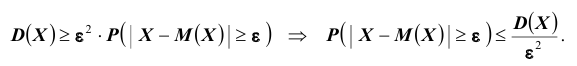

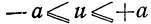

Вероятность того, что отклонение случайной величины Х, имеющей конечную дисперсию

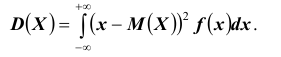

Доказательство: По определению дисперсии для непрерывной случайной величины можем записать

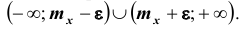

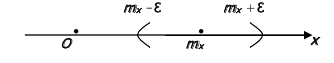

Выделим на числовой оси

Так как под знаком интеграла стоит неотрицательная функция

Интеграл в правой части полученного неравенства – это вероятность того, что случайная величина Х будет принимать значения вне интервала

12 Есть и другая формулировка: Вероятность того, что отклонение случайной величины Х от её математического ожидания по абсолютной величине меньше положительного числа

13 Напомним, что

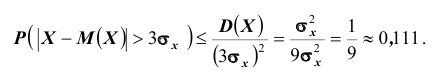

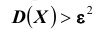

Замечание. Неравенство Чебышева имеет для практики ограниченное значение, поскольку часто даёт грубую, а иногда и тривиальную

(не представляющую интереса) оценку. Например, если

Теоретическое же значение неравенства Чебышева весьма велико. Оценка, полученная Чебышевым, является универсальной, она справедлива для любых случайных величин, имеющих

Пример №1

Найти вероятность выхода случайной величины Х, имеющей математическое ожидание

Решение. Воспользуемся неравенством Чебышева:

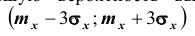

Сравним полученный результат с тем, который следует из правила трёх сигм

для нормального закона распределения:

Нетрудно сделать ВЫВОД: случайные величины, встречающиеся на практике, чаще всего имеют значительно меньшую вероятность выхода за

трёхсигмовые границы, чем 1/9. Для них область

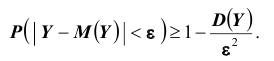

ТЕОРЕМА Чебышева (частный случай): Пусть

Доказательство. Применим к случайной величине

А так как вероятность не может быть больше единицы, то отсюда и следует

утверждение теоремы.

Теорема Чебышева была обобщена на более общий случай, доказательство которой проводится аналогично доказательству, предложенному выше.

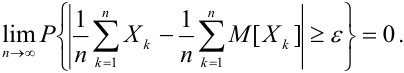

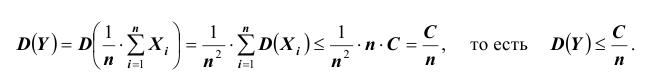

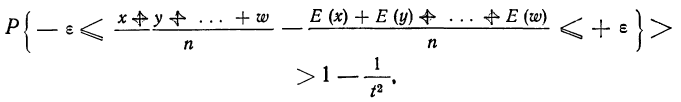

ТЕОРЕМА Чебышева (общий случай): Пусть

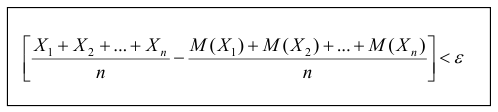

равномерно ограничены (то есть не превышают некоторого постоянного числа С). Тогда, при достаточно большом числе независимых опытов среднее арифметическое наблюдаемых значений случайных величин сходится по вероятности к среднему арифметическому их математических ожиданий, то есть имеет место равенство:

Сущность теоремы Чебышева

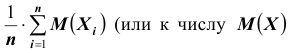

Сущность доказанной теоремы такова: хотя отдельные независимые случайные величины могут принимать значения далёкие от своих математических ожиданий, среднее арифметическое достаточно большого числа случайных величин с большой вероятностью принимает значения близкие к определённому постоянному числу, а имен к числу

их среднее арифметическое. Итак, среднее арифметическое достаточно большого числа независимых случайных величин (дисперсии которых равномерно ограничены) утрачивает характер случайной величины. Объясняется это тем, что отклонения каждой из величин от своих математических ожиданий могут быть как положительными, так и отрицательными, а в среднем арифметическом они взаимно погашаются

Значение теоремы Чебышева для практики

Приведём примеры применения теоремы Чебышева к решению практических задач. Обычно для измерения некоторой физической величины производят несколько измерений и их среднее арифметическое принимают в качестве искомого размера. При каких условиях этот способ измерения можно считать правильным? Ответ на этот вопрос даёт теорема Чебышева (частный случай). Действительно, рассмотрим результаты каждого измерения как случайные величины

как угодно близка к единице. Другими словами, при достаточно большом числе измерений почти достоверно, что их среднее арифметическое сколь угодно мало отличается от истинного значения измеряемой величины. Итак, теорема Чебышева указывает условия, при которых описанный способ измерения может быть применим

Однако ошибочно думать, что увеличивая число измерений можно достичь сколь угодно большой точности. Дело в том, что сам прибор даёт показания лишь с точностью поэтому каждый из результатов измерений, а следовательно и их среднее арифметическое, будут получены лишь с точностью, не превышающей точности прибора.

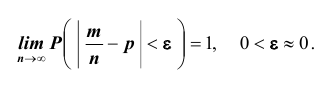

Теорема Бернулли

Пусть производится n независимых испытаний, в каждом из которых вероятность появления события А равна р. Другими словами, пусть имеет место схема Бернулли. Можно ли предвидеть какова будет примерно относительная частота появлений события? Положительный ответ на этот вопрос даёт теорема, доказанная Я.Бернулли

положила начало теории вероятностей как науки

ТЕОРЕМА Бернулли: Если в каждом из n независимых испытаний, проводимых в одинаковых условиях, вероятность р появления события А

постоянна, то относительная частота появления события А сходится по вероятности к вероятности р – появления данного события в отдельном опыте, то есть

Доказательство впервые было опубликовано в 1713 году.

Доказательство, предложенное Я.Бернулли, было сложным; более простое доказательство было дано П.Чебышевым в 1846 году.

Можно ли применить к рассматриваемым величинам теорему Чебышева?

Можно, если случайные величины попарно независимы и дисперсии их равномерно ограничены. Оба условия выполняются. Действительно, попарная независимость величин

Тогда, применяя теорему Чебышева к рассматриваемым величинам, получим:

Замечание 1: Теорема Бернулли является простейшим частным случаем теоремы Чебышева.

Замечание 2: На практике часто неизвестные вероятности приходится приближённо определять из опыта, то для проверки согласия теоремы Бернулли с опытом было проведено большое число опытов. Так, например, французский естествоиспытатель XVIII века Бюффон бросил монету 4040 раз. Герб выпал при этом 2048 раз. Частота появления герба в опыте Бюффона приближённо равна 0,507. Английский статистик К.Пирсон бросал монету 12 000 раз и при этом наблюдал 6019 выпадений герба. Частота выпадения герба в этом опыте Пирсона равна 0,5016. В другой раз он бросил монету 24 000 раз, и герб при этом выпал 12 012 раз; частота выпадения герба при этом оказалась равной 0,5005. Как видим,

во всех приведённых опытах частота лишь немного уклонилась от вероятности 0,5 – появления герба в результате одного бросания монеты.

Известно, что произведение двух сомножителей, сумма которых есть величина постоянная, имеет наибольшее значение при равенстве сомножителей.

Теоремы Пуассона и Маркова

Замечено, если условия опыта меняются, то свойство устойчивости относительной частоты появления события А сохраняется. Это обстоятельство доказано Пуассоном.

ТЕОРЕМА Пуассона: При неограниченном увеличении числа независимых испытаний, проводимых в переменных условиях, относительная частота появления события А сходится по вероятности к среднему арифметическому вероятностей появления данного события в каждом из опытов, то есть

Замечание 4: Нетрудно убедиться, что теорема Пуассона является частным случаем теоремы Чебышева. Далее, закон больших чисел применительно к зависимым событиям был дан А.А.Марковым, который заметил, что рассуждения Чебышева позволяют получить

более общий результат.

ТЕОРЕМА Маркова: Если последовательность случайных величин

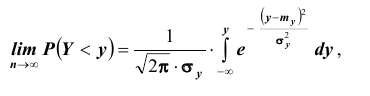

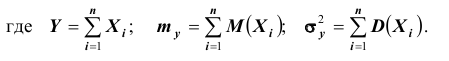

Центральная предельная теорема (Теорема Ляпунова)

Рассмотренные теоремы закона больших чисел касаются вопросов приближения некоторых случайных величин к определённым предельным значениям независимо от их закона распределения. В теории вероятностей, как уже отмечалось, существует другая группа теорем, касающихся предельных законов распределения суммы случайных величин. Общее название этой группы теорем – центральная предельная терема. Различные её формы различаются условиями, накладываемыми на сумму составляющих случайных величин. Впервые одна из форм центральной предельной теоремы была доказана выдающимся русским математиком А.М.Ляпуновым в 1900 году с использованием специально разработанного им метода характеристических функций.

ТЕОРЕМА Ляпунова: Закон распределения суммы независимых случайных величин

Ни одна из случайных величин по степени своего влияния на всю сумму случайных величин не отличается от остальных (то есть, влияние каждой из случайных величин на всю сумму ничтожно мало. Другими словами выполняется условие:

Следует отметить, что центральная предельная теорема справедлива не только для непрерывных, но и для дискретных случайных величин. Практическое значение теоремы Ляпунова огромно. Опыт показывает, что закон распределения суммы независимых случайных величин, сравнимых по своему рассеиванию, достаточно быстро приближается к нормальному. Уже при числе слагаемых порядка десяти закон распределения суммы можно заменить на нормальный (в частности, примером такой суммы может быть среднее арифметическое наблюдаемых значений случайных величин, то есть

Частным случаем центральной предельной теоремы является теорема Лапласа. В ней, как вы помните, рассматривается случай, когда случайные величины

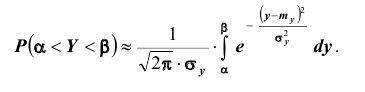

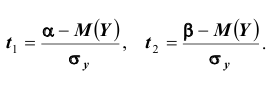

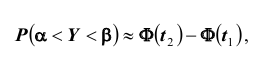

Далее, вероятность того, что Y заключено в интервале

Используя функцию Лапласа, последнюю формулу можно записать в удобном для расчётов виде:

Пример №2

Пусть производится измерение некоторой физической величины. Любое измерение даёт лишь приближённое значение измеряемой величины, так как на результат измерения оказывают влияние очень многие независимые случайные факторы (температура, колебания прибора, влажность и др.). Каждый из этих факторов порождает ничтожную «частную ошибку». Однако, поскольку число этих факторов очень велико, совокупное их действие порождает уже заметную «суммарную ошибку». Рассматривая суммарную ошибку как сумму очень большого числа взаимно независимых частных ошибок, мы вправе заключить, что суммарная ошибка имеет распределение, близкое к нормальному. Опыт подтверждает справедливость такого заключения.

Понятие закона больших чисел

В материалах сегодняшней лекции мы рассмотрим закон больших чисел.

Что такое закон больших чисел

На практике сложно сказать какое конкретное значение примет случайная величина, однако, при воздействии большого числа различных факторов поведение большого числа случайных величин практически утрачивает случайный характер и становится закономерным.

Этот факт очень важен на практике, т.к. позволяет предвидеть результат опыта при воздействии большого числа случайных факторов.

Однако, это возможно только при выполнении некоторых условий, которые определяются законом больших чисел. К законам больших чисел относятся теоремы Чебышева (наиболее общий случай) и теорема Бернулли (простейший случай), которые будут рассмотрены далее.

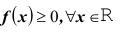

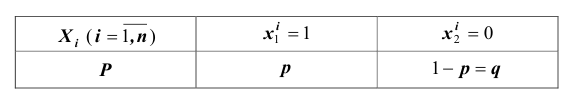

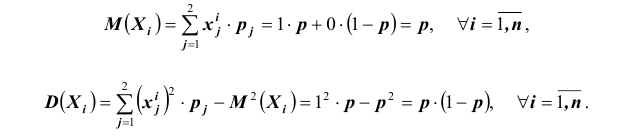

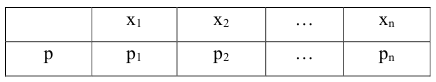

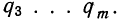

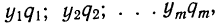

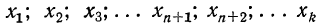

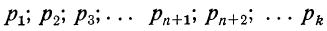

Рассмотрим дискретную случайную величину X (хотя все сказанное ниже будет справедливо и для непрерывных случайных величин), заданную таблицей распределения:

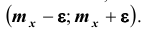

Требуется определить вероятность того, что отклонение значения случайной величины от ее математического ожидания будет не больше, чем заданное число £.

Теорема. (Неравенство Чебышева) Вероятность того, что отклонение случайной величины X от её математического ожидания по абсолютной величине меньше положительного числа

Доказательство этой теоремы приводить не будем, оно имеется в литературе.

Теорема Чебышева

Теорема. Если

будет сколь угодно близка к единице, если число случайных величин дост а точно велико.

Т.е. можно записать:

Часто бывает, что случайные величины имеют одно и то же математическое ожидание. В этом случае теорема Чебышева несколько упрощается:

Дробь, входящая в записанное выше выражение есть не что иное, как среднее арифметическое возможных значений случайной величины.

Теорема утверждает, что хотя каждое отдельное значение случайной величины может достаточно сильно отличаться от своего математического ожидания, но среднее арифметическое этих значений будет неограниченно приближаться к среднему арифметическому математических ожиданий.

Отклоняясь от математического ожидания, как в положительную, так и в отрицательную сторону, от своего математического ожидания, в среднем арифметическом отклонения взаимно сокращаются.

Таким образом, величина среднего арифметического значений случайной величины уже теряет характер случайности.

Теорема Бернулли

Пусть производится n независимых испытаний, в каждом из которых вероятность появления события А равно р.

Возможно определить примерно относительную частоту появления события А.

Теорема. Если в каждом из n независимых испытаний вероятность р появления события А постоянно, то сколь угодно близка к единице вероятность того, что отклонение относительной частоты от вероятности р по абсолютной величине будет сколь угодно малым, если число испытаний р достаточно велико.

Теорема Пуассона

В случае, если вероятности появления события А в каждом опыте различны, то справедлива следующая теорема, известная как теорема Пуассона.

Теорема. Если производится п независимых опытов и вероятность появления события А в каждом опыте равна

вероятностей

Предельные теоремы

Как уже говорилось, при достаточно большом количестве испытаний, поставленных в одинаковых условиях, характеристики случайных событий и случайных величин становятся почти неслучайными. Это позволяет использовать результаты наблюдений случайных событий для предсказания исхода того или иного опыта.

Предельные теоремы теории вероятностей устанавливают соответствие между теоретическими и экспериментальными характеристиками случайных величин при большом количестве испытаний.

В рассмотренном выше законе больших чисел нечего не говорилось о законе распределения случайных величин.

Поставим задачу нахождения предельного закона распределения суммы

когда число слагаемых n неограниченно возрастает. Эту задачу решает Центральная предельная теорема Ляпунова.

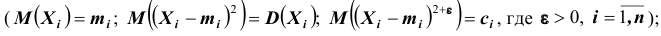

В зависимости от условий распределения случайных величин

Допустим, что случайные величины

Теорема. Если случайные величины

При доказательстве этой теоремы Ляпуновым использовались так называемые характеристические функции.

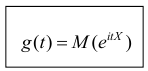

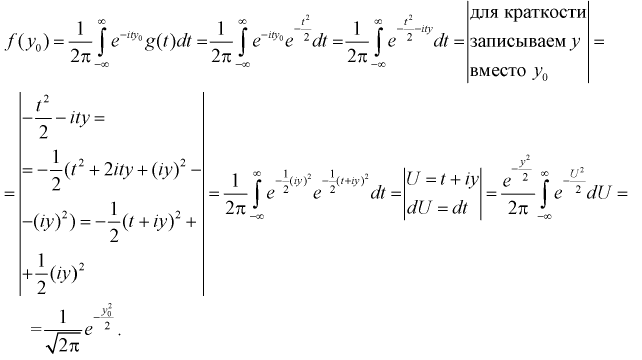

Определение. Характеристической функцией случайной величины X называется функция

эта функция представляет собой математическое ожидание некоторой комплексной случайной величины

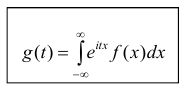

Зная закон распределения, можно найти характеристическую функцию по формуле (для непрерывных случайных величин):

Как видим, данная формула представляет собой не что иное, как преобразование Фурье для функции плотности распределения. Очевидно, что с помощью обратного преобразования Фурье можно по характеристической функции найти закон распределения.

Введение характеристических функций позволяет упростить операции с числовыми характеристиками случайных величин.

В случае нормального распределения характеристическая функция имеет вид:

Сформулируем некоторые свойства характеристических функций:

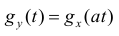

1) Если случайные величины X и У связаны соотношением

Y = aX

2) Характеристическая функция суммы независимых случайных величин равна произведению характеристических функций слагаемых.

Случайные величины

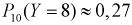

Данная теорема позволяет существенно упростить вычисление по формуле биноминального распределения.

Расчёт вероятности попадания значения случайной величины в заданный интервал

Примеры с решением

Пример №3

Пусть

1. Случайные величины

Тогда вероятность при

Пример №4

Пусть проводится эксперимент с броском монеты. Обозначим через событие

Мы увидим, что относительная частота будет колебаться около некоторого постоянного числа (в случае с симметричной монетой это 0,5). И это значение можно принимать за неизвестную вероятность события

Пример №5

Показать, что характеристическая функция

Используем обратное преобразование Фурье:

Пример №6

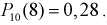

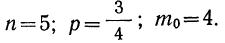

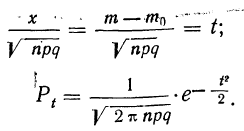

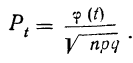

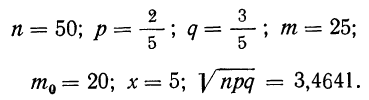

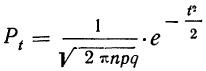

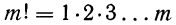

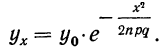

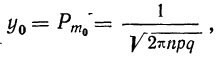

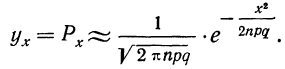

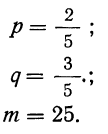

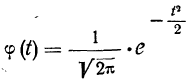

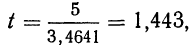

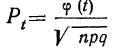

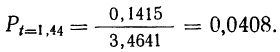

Вероятность успешной работы телевизора после сборки равна 0,75. Найти вероятность того, что из 10 телевизоров 8 заработают. Используем локальную теорему Лапласа и получаем

Заключение по лекции:

В лекции мы рассмотрели закон больших чисел.

Закон больших чисел

При статистической обработке опытных данных используют определения и правила, установленные теорией вероятностей.

Теория вероятностей—математическая наука, возникшая в середине XVII столетия. Первые работы, в которых зарождались основные понятия теории вероятностей, принадлежали Б. Паскалю, П. Ферма и X. Гюйгенсу. Дальнейшее развитие теории вероятностей связано с именем Я Бернулли, доказавшим теорему, впоследствии названную законом больших чисел. В XIX столетии теория вероятностей начала успешно применяться в страховом деле, статистике народонаселения, биологической статистике и в артиллерийской стрельбе. В этот период она обогатилась работами А. Муавра, П. Лапласа, К. Гаусса и С. Пуассона. »

Наиболее плодотворный для развития теории вероятностей период связан с именами П. Л. Чебышева и его учеников А. А. Маркова и А. М. Ляпунова, усилиями которых она была превращена в стройную математическую науку.

Велика заслуга русских и советских ученых С. Н. Бернштейна, В. И. Романовского, А. Н. Колмогорова, А. Я. Хинчина, Б. В. Гнеденко, Н. В. Смирнова, Б. С. Ястремского и др., своими исследованиями внесших крупный вклад в теорию вероятностей и сделавших важные открытия, приведшие к созданию новых ее ветвей.

В настоящее время теория вероятностей весьма плодотворно применяется в статистике производств, при анализе технологических процессов, статистическом предупредительном контроле качества продукции, в физике, биологии и т. д.

Объектом теории вероятностей является измерение степени возможности различных случайных, результатов. Знание выявленных с помощью теории вероятностей закономерностей позволяет предвидеть, как эти события будут протекать в дальнейшем.

Испытанием или опытом называют комплекс условий, в которых могут осуществиться или не осуществиться рассматриваемые события (результаты).

Случайное событие определяется как событие, которое может произойти или не произойти, в отличие от достоверного события, которое обязательно осуществляется (при данных условиях), и невозможного события, осуществление которого при данных условиях исключается. Для обозначения событий приняты буквы А, Б, В и т. д. При многократном повторении комплекса условий мы имеем серию испытаний.

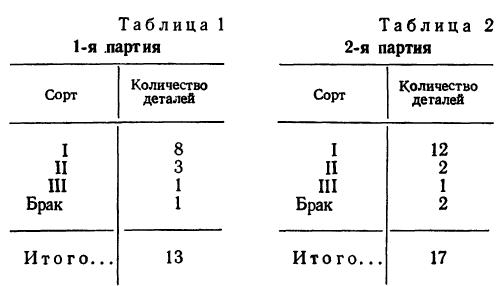

Пусть, например, имеется совокупность, состоящая из деталей различных сортов. По жребию или другим аналогичным способам (наудачу) из совокупности отбирается одна деталь.

В этом случае испытанием является отбор одной детали. Появление при этом детали определенного сорта называется случайным событием. Если отбор одной детали из совокупности будет повторяться несколько раз, то это будет серией испытаний.

Несовместимые и совместимые события. События А, Б,

В. называются несовместимыми, если в условиях испытания возможно появление только одного из них, т. е. если они не могут появиться одновременно. Так, отобранная в результате испытания деталь не может быть одновременно первосортной и второсортной, так как эти события несовместимы. Если же появление одного события не исключает появления другого, то эти события называются совместимыми. Например, имеются две совокупности деталей, содержащих детали различных сортов. Из каждой совокупности отбирается по одной детали. В этом случае отборы первосортной детали из первой и из второй совокупностей будут событиями совместимыми.

Понятие о равновозможности

Если из совокупности, состоящей из N единиц, обладающих некоторыми признаками, отбирается одна единица и при этом никакой, из единиц, состав; ляющих данную совокупность, не отдается предпочтения по сравнению с другими, то говорят, что каждой единице обеспечена равная возможность быть отобранной (принцип равновозможности). О равновозможности событий можно судить либо исходя из общих свойств изучаемых явлений (выпадение каждой грани идеально правильной и материально однородной игральной кости считают равновозможным событием), либо по числу появлений событий в достаточно большой серии испытаний. Так, если при бросании игральной кости 600 раз каждая грань выпадает приблизительно по 100 раз, то мы считаем выпадение каждой грани равновозможными событиями.

В случае соблюдения принципа равновозможности выбор вполне определенной конкретной единицы имеет один шанс (случай) из числа N таких же шансов. Выбор же единицы, обладающей данным значением признака (например, первосортной детали, число которых во всей совокупности М) имеет М равновозможных шансов из N таких же шансов.

Математическая вероятность события

Измерение вероятностей основывается на подсчете шансов. Математическая вероятность того, что событие А произойдет, измеряется отношением числа шансов (равновозможных и несовместимых), благоприятствующих данному событию А (М), к общему числу благоприятствующих и неблагоприятствующих шансов (N):

Такое определение вероятности называют классическим. При таком понимании вероятности мы ограничиваем сферу ее практического применения только такими событиями, которые допускают различение дискретных шансов.

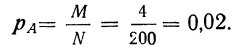

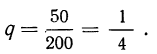

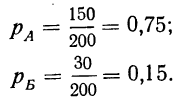

Пример 1. Из партии в 200 деталей, среди которых 4 бракованные и 196 доброкачественных (соответствующих стандарту), производится выборка одной детали. Как велика вероятность того, что отобранная деталь окажется бракованной? Находим вероятность события А в соответствии с приведенным выше определением вероятности. Из возможных 200 случаев исхода данного отбора 4 случая благоприятствуют событию А, вероятность которого мы ищем. Поэтому:

Повторный и бесповторный отбор

Отбор единиц из совокупности, при котором каждая отобранная и обследованная единица в совокупность не возвращается и в дальнейших испытаниях не участвует, называют бесповторным отбором, или отбором по схеме невозвращенного шара. Если же после обследования отобранной из совокупности единицы она мыслится возвращенной в совокупность и может быть повторно отобрана, то такой отбор называют повторным, или отбором по схеме возвращенного шара.

Зависимые и независимые событи

События А, Б, В. называют зависимыми друг от друга, если вероятность появления хотя бы одного из них изменяется в зависимости от появления или непоявления других событий. Примером зависимых событий являются события, происходящие при отборе единиц из совокупности по схеме невозвращенного шара, когда от появления годного или бракованного изделия при первом испытании зависит вероятность появления годного изделия при втором испытании.

Так, если из совокупности 30 деталей, содержащих 27 годных и 3 бракованные детали, отбирается при первом испытании одна деталь и не возвращается в совокупность, то вероятность отбора годной детали при втором испытании будет зависеть от того, какая деталь была отобрана при первом испытании: если при персом испытании была отобрана годная деталь, то вероятность отбора годной детали при втором испытании будет равна

События называются независимыми, если вероятности появления каждого из них не зависят от появления или непоявления прочих из них.

Простые и сложные события

События, происходящие в результате совпадения или последовательного появления нескольких событий, называются сложными событиями, а события, их составляющие, — простыми. Так, если мы отбираем из совокупности, содержащей детали различных сортов, последовательно три детали первого сорта, то это событие будет сложным, состоящим из совпадения трех событий: отбор детали первого сорта в каждом из трех испытаний.

Статистическая вероятность

Кроме математической вероятности случайного события, определяемой непосредственным подсчетом равновозможных и несовместимых шансов, имеется статистическое понимание вероятности. Если в результате достаточно большого числа испытаний установлено, что частость случайного события

Если вероятность случайного события определяется до испытания, приведшего к определенному исходу, то численное значение этой вероятности называют априорным (доопытным).

Вероятность события после опыта, приведшего к определенному результату, в отличие от доопытной вероятности называют апостериорной вероятностью.

§ 9. Вероятность того, что событие А не произойдет

Полученную вероятность называют вероятностью противоположного события.

Пример 2. По данным примера 1 найти вероятность того что отобранная деталь не окажется бракованной, т. е. окажется доброкачественной.

Число случаев, благоприятствующих тому, что отобранная деталь не окажется бракованной, равно 200—4 = 196

§ 10. Сумма вероятностей двух противоположных событий, т. е. таких, из которых в результате испытания может произойти либо одно, либо другое, равна единице:

Отсюда вытекает, что, зная вероятность события А, можно вычитанием ее из единицы определить вероятность того, что А не произойдет

Пример 3. Используя результат, полученный в примере 1 по вероятности события А, найдем вероятность противоположного события.

тогда:

Достоверное событие

Если все N случаев благоприятствуют событию А (M = N), то вероятность события А равна единице. Такое событие называется достоверным

Пример 4. Если в партии из 200 деталей все 200 доброкачественны, то вероятность того, что отобранная наудачу деталь окажется доброкачественной, есть событие достоверное

Невозможное событие

Если число случаев, благоприятствующих событию А, равно нулю (M = 0), то вероятность события А равна нулю. Такое событие называется невозможным

Пример 5. Если в партии из 200 деталей нет ни одной бракованной, то вероятность того, что отобранная деталь окажется бракованной, равна нулю. Это событие невозможно

Пределы вероятностей

Вероятности событий находятся в пределах от нуля до единицы

Чем ближе к единице вероятность события, тем оно достовернее.

При решении различных задач по исчислению вероятностей событий используются основные теоремы теории вероятностей.

Теорема сложения вероятностей

Если события А и Б несовместимы, то вероятность того, что произойдет — или событие А, или событие Б

где

Теорема сложения вероятностей может быть распространена на три и более несовместимых событий.

Пример 6. Партия из 200 деталей состоит из 150 деталей I сорта, 30 деталей II сорта, 16 деталей III сорта и 4 бракованных деталей.

Как велика вероятность того, что отобранная наудачу деталь будет либо I сорта, либо II сорта?

Так как при данных условиях событие А (I сорт) и событие Б (II сорт) несовместимы (одно из них исключает возможность другого), то можно применить теорему сложения вероятностей.

Следовательно:

или

Такие несовместимые события, сумма вероятностей которых равна единице, составляют полную группу событий. Если полная группа состоит из двух событий, то эти события называются противоположными.

Пример 7. По данным примера 6. найти вероятность того, что отобранная наудачу деталь окажется либо I, либо II, либо III сорта, либо бракованной.

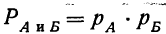

Первая теорема умножения вероятностей

Если имеется сложное событие, состоящее из совпадения двух независимых друг от друга событий (А и Б), то вероятность того, что произойдет это сложное событие (включающее в себя и событие А и событие Б), равна произведению вероятностей каждого события:

Указанная теорема может быть распространена и на сложные события, состоящие из нескольких (более двух) независимых событий.

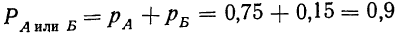

Пример 8. Имеются две партии деталей:

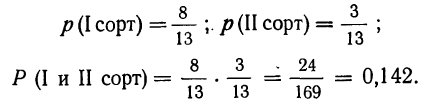

Из каждой партии наудачу отбирается по одной детали. Как велика вероятность того, что отобранные две детали окажутся I сорта?

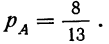

Данное событие является сложным и состоит из двух простых: отбор детали I сорта из 1-й партии (событие А) и отбор детали I сорта из 2-й партии (событие Б). Оба простых события А и Б независимы, так как вероятность отбора детали I сорта из 2-й партии не зависит от того, окажется ли отобранная деталь I сорта из 1-й партии. Следовательно, можно применить. 1-ю теорему умножения вероятностей.

Имеем:

Пример 9. Сохраняя условие примера 8, произведем наудачу выборку двух деталей только из 1-й партии с возвратом 1-й отобранной детали после ее извлечения. Как велика вероятность, того, что 1-я деталь окажется I сорта, а 2-я—II сорта?

В данном случае налицо все условия применения 1-й теоремы умножения вероятностей.

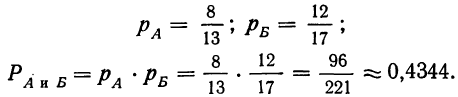

Следствие 1-й теоремы умножения вероятностей

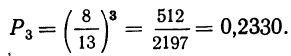

Вероятность повторения события A k раз при k независимых испытаниях, в которых вероятность его остается одинаковой, равна вероятности события А при каждом испытании, возведенной в степень k:

Пример 10. По данным примера 8. находим вероятность того, что при отборе наудачу трех деталей из 1-й партии (по одной с возвратом) все три детали окажутся I сорта. Вероятность появления детали I сорта при одном испытании:

Находим вероятность того, что все три детали окажутся I сорта:

Условная вероятность

Условной вероятностью события Б

Вторая теорема умножения вероятностей

Вероятность сложного события, состоящего из двух простых зависимых событий, равна произведению вероятностей одного события на условную вероятность другого:

Пример 11. По данным примера 8 по выборке из 1-й партии определить вероятность того, что при отборе двух деталей (без возврата) первая отобранная деталь окажется I сорта, а вторая — II сорта.

Вероятность того, что первая деталь окажется I сорта:

Предполагая, что данное событие условную вероятность второго события

осуществилось, находим

Вычисляем вероятность сложного события, состоящего из двух простых зависимых событий:

Полная вероятность события А

Если некоторое событие А может произойти только тогда, когда имеет место какая-нибудь из нескольких гипотез, то полная вероятность события А равна сумме произведений вероятностей гипотез на вероятности события А при условии осуществления каждой данной гипотезы:

где

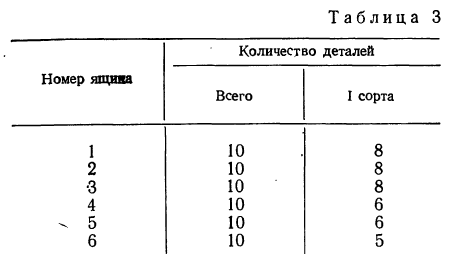

Пример 12. Имеется 6 ящиков, одинаковых по внешнему виду и по числу содержащихся в них деталей, но с разным количеством деталей I сорта.

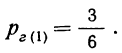

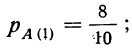

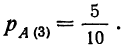

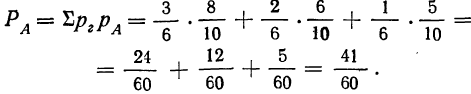

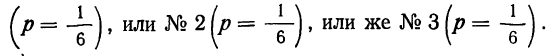

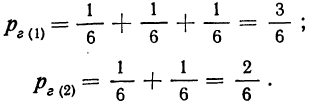

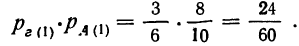

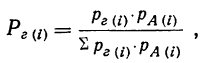

Определить полную вероятность того, что при выборке наудачу одной детали она окажется первосортной.

Вероятность предположения, что отобранная деталь окажется взятой из ящиков, содержащих 8 деталей 1 сорта (ящики № 1, 2 и 3—гипотеза первая), может быть исчислена как отношение числа ящиков, благоприятствующих этому исходу, к общему числу ящиков:

Вероятность второй гипотезы, т. е. того, что деталь окажется взятой из ящиков, содержащих 6 деталей I сорта (ящики № 4 и 5):

Вероятность третьей гипотезы (ящик № 6):

Определим вероятность событий А, т. е. отбора детали I сорта, по гипотезам.

Вероятность отбора детали I сорта по первой гипотезе:

по второй гипотезе:

по третьей гипотезе:

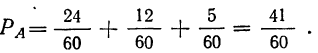

Определяем полную вероятность события А:

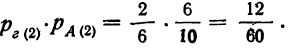

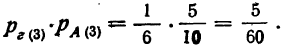

Здесь применена сначала теорема сложения вероятностей, затем теорема умножения вероятностей и, наконец, еще раз теорема сложения вероятностей. Когда мы определяли вероятность гипотезы, то считали, что вероятность первой гипотезы равна

Следовательно, вероятность первых двух гипотез мы и получили, складывая вероятности каждого из событий, составляющих эту гипотезу:

Вероятность того, что произойдет первое сложное событие, состоящее в том, что отобранная деталь окажется взятой по первой гипотезе из ящиков, содержащих 8 деталей I сорта, и будет первосортной, мы определяли по теореме умножения вероятности:

Вероятность второго сложного события, состоящего в том, что отобранная деталь окажется взятой по второй гипотезе из ящиков, содержащих 6 деталей I сорта, и будет первосортной:

Так же получена и вероятность третьего сложного события:

Для того чтобы отобранная деталь оказалась I сорта, должно иметь место либо первое сложное событие, либо второе, либо третье. Поэтому исчисленные вероятности этих событий мы складывали, применяя снова теорему сложения вероятностей:

Теорема деления вероятностей

Из теоремы умножения вероятностей видно, что условная вероятность события Б при предположении, что событие А имело место, может быть определена как отношение вероятности совместного совершения обоих событий А и Б к вероятности события А:

Теорема Байеса или теорема о вероятности гипотез дает возможность судить о величине вероятности какого-либо предположения после опыта, давшего определенный результат, и формулируется следующим образом: вероятность гипотезы i после испытания, приведшего к осуществлению события А, равна произведению вероятности этой гипотезы до испытания на вероятность события по этой гипотезе, деленному на полную вероятность события А, т. е. на сумму таких произведений для всех гипотез:

где

данная гипотеза осуществилась.

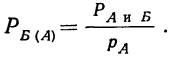

Применяя теорему Байеса, удобно пользоваться следующей схемой (см. табл. 4).

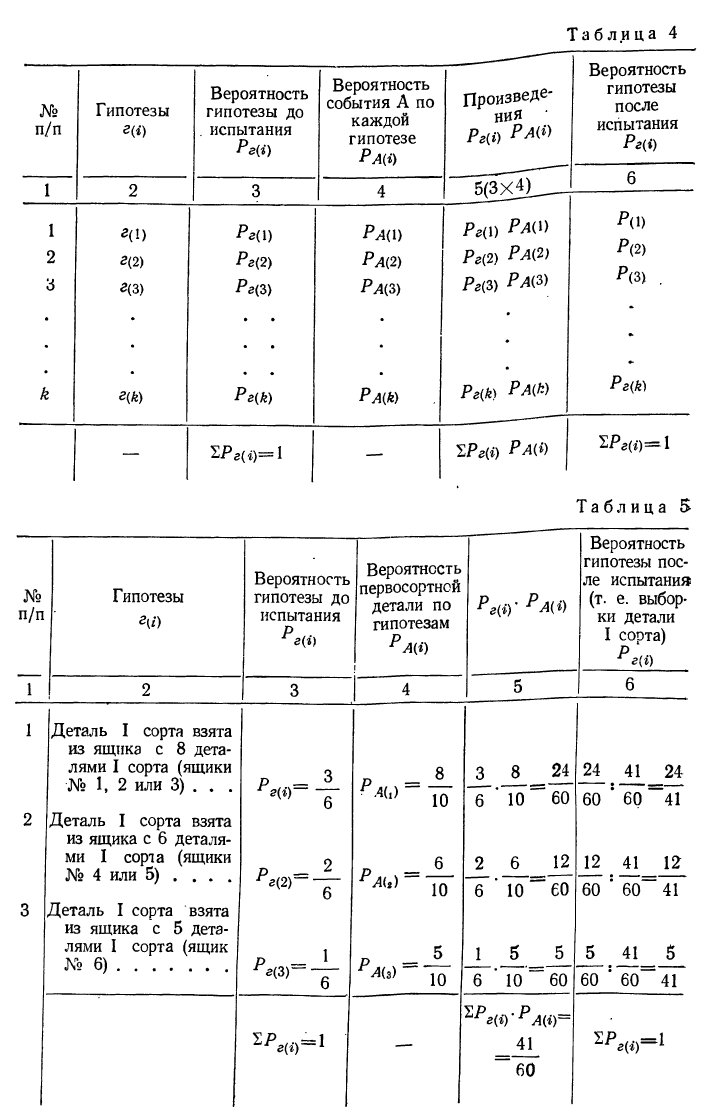

Пример 13. Используя данные примера 12, предположим, что мы выбрали наудачу один ящик и из него отобрали одну деталь, которая оказалась I сорта. Требуется определить вероятность того, что: 1) отобранный ящик содержал 8 деталей I сорта (т. е. оказался ящиком № 1, 2 или 3), 2) отобранный ящик содержал 6 деталей I сорта (т. е. оказался ящиком № 4 и 5) и 3) отобранный ящик содержал 5 деталей I сорта (т. е. оказался ящиком № 6).

Для исчисления искомых вероятностей расположим все исходные и расчетные показатели в таблицу (см. табл. 5).

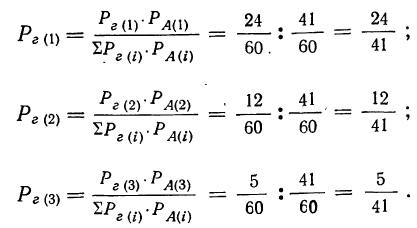

Окончательный расчет для ответа на все три вопроса дан в колонке 6. По теореме Байеса получаем:

Сумма вероятностей гипотез до испытания и после испытания равна 1 (что видно из сумм колонок 3 и 6).

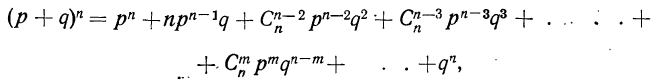

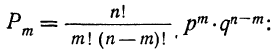

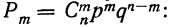

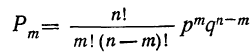

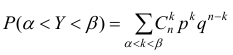

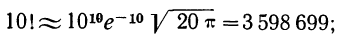

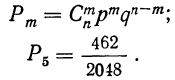

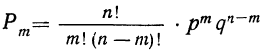

Биномиальный закон вероятностей при n повторных независимых испытаниях очень часто называют бернуллиевым распределением вероятностей.

При повторных независимых испытаниях, в каждом из которых может осуществиться некоторое событие А (с одной и той же вероятностью р), вероятности любого числа его появлений соответствуют членам разложения бинома Ньютона в степени равной числу испытаний

где

n — число испытаний;

m—число осуществлений события А или частота события А;

Таким образом, вероятность осуществления события А m раз в n независимых испытаниях с одинаковой вероятностью р можно рассчитать по формуле общего члена разложения бинома Ньютона:

где

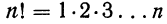

Примечание. 0! считается равным единице (см. гамму-функцию от n стр. 147.)

Пример 14. По данным примера 6 найти вероятность того, что при отборе наудачу 5 деталей:

1) все 5 деталей окажутся I сорта;

2) 4 детали — I сорта и 1 деталь—не I сорта;

3) 3 детали — I сорта и 2 детали — не I сорта;

4) 2 детали — I сортa и 3 детали—не I сорта;

5) 1 деталь —I сорта и 4 детали — не I сорта;

6) все 5 деталей окажутся не I сорта.

Вероятности отбора детали I сорта при единичном испытании:

Вероятность отбора детали не I сорта при единичном испытании:

Рассчитываем по формуле

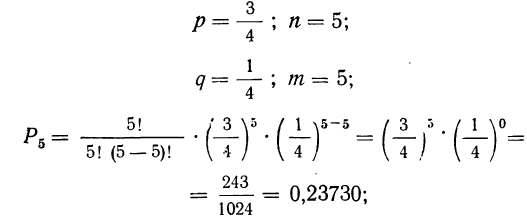

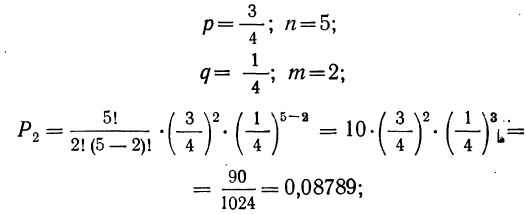

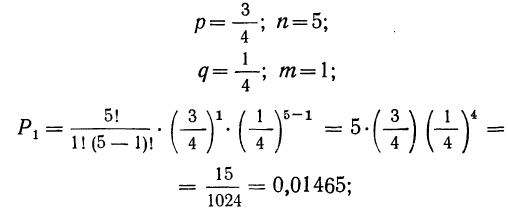

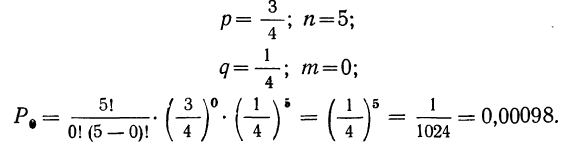

1) вероятность того, что все 5 деталей окажутся I сорта

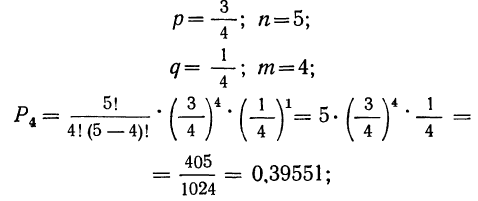

2) вероятность того, что 4 детали окажутся I сорта, а одна деталь не I сорта

3) вероятность того, что 3 детали окажутся I сорта, а 2 детали не I сорта

4) вероятность того, что 2 детали окажутся I сорта, а 3 детали не I сорта

5) вероятность того, что 1 деталь окажется I сорта, а 4 детали не I сорта

6) вероятность того, что все 5 деталей окажутся не I сорта

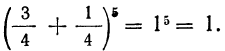

Сумма всех найденных вероятностей равна:

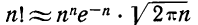

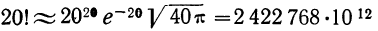

Формула Стирлинга

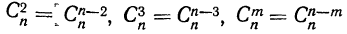

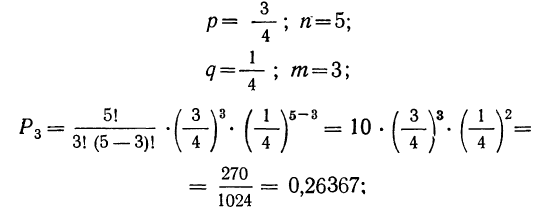

При расчете вероятностей бернуллиевого распределения

или более точной:

Точность данной формулы возрастает при увеличении числа n. Относительная погрешность составляет

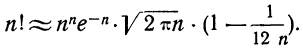

Пример 15. Найдем по формуле Стирлинга 10! и 20! и оценим допущенные при этом ошибки.

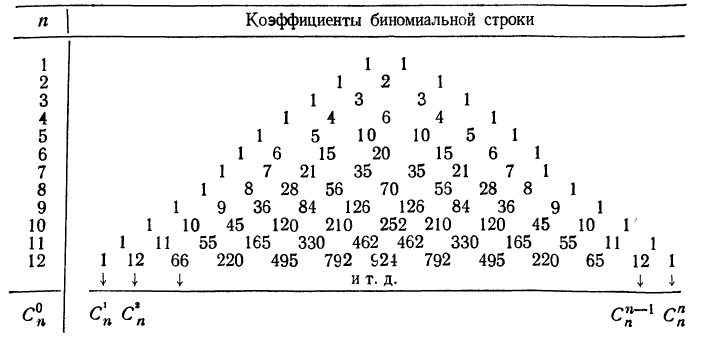

§ 22. Для определения коэффициентов при разложении вероятностей в биномиальную строку используют треугольник

Паскаля, в котором каждый коэффициент строки образуется сложением двух стоящих над ним (справа и слева) коэффициентов предыдущей строки.

Пример 16. В примере 14 нам необходимы были коэффициенты разложения бинома при n = 5, которые можно взять из треугольника Паскаля (см. 5-ю строку).

При n = 5 имеем коэффициенты: 1; 5; 10; 10; 5; 1.

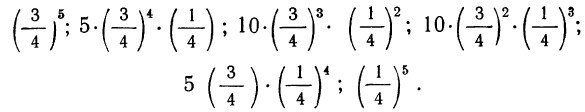

Следовательно, искомые вероятности соответственно равны:

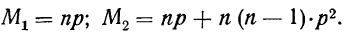

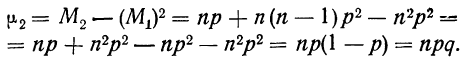

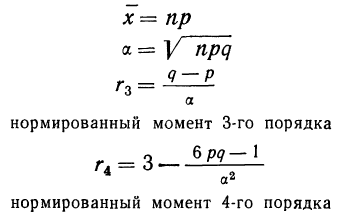

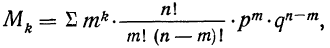

В качестве характеристик биномиального распределения признака (бернуллиево распределение) используют начальные, начальные относительно

где m—число появлений события;

р — вероятность события;

n — число испытаний.

Центральные моменты получаются из начальных по общему правилу (см. раздел I, § 41).

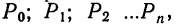

Биномиальный ряд может быть представлен следующими характеристиками:

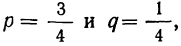

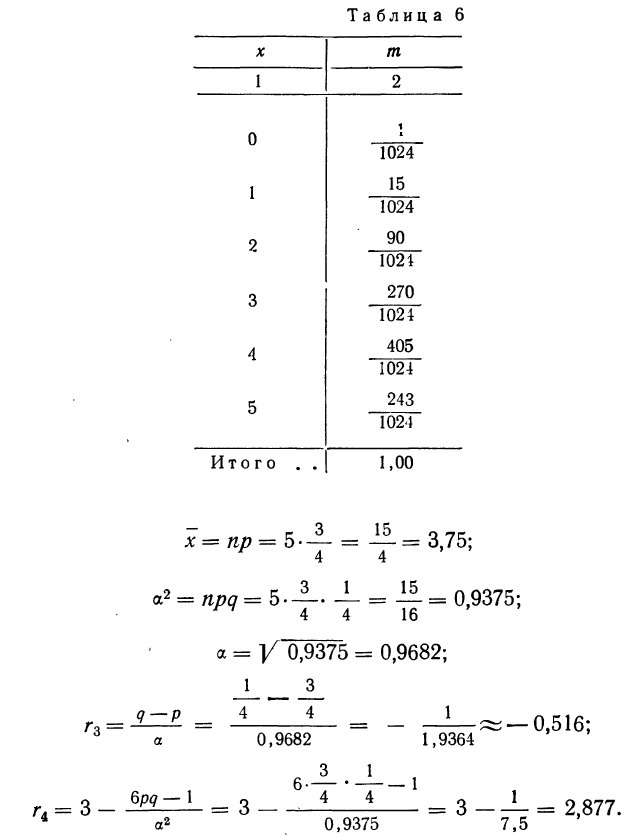

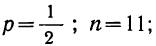

Пример 17. Пусть дан вариационный ряд, в котором числа появлений события будут рассматриваться как варианты (x), а вероятности данного исхода при n = 5;

считанные по формуле разложения вероятностей в биномиальную строку, — как частоты (m). Вычислим характеристики данного ряда по указанным формулам:

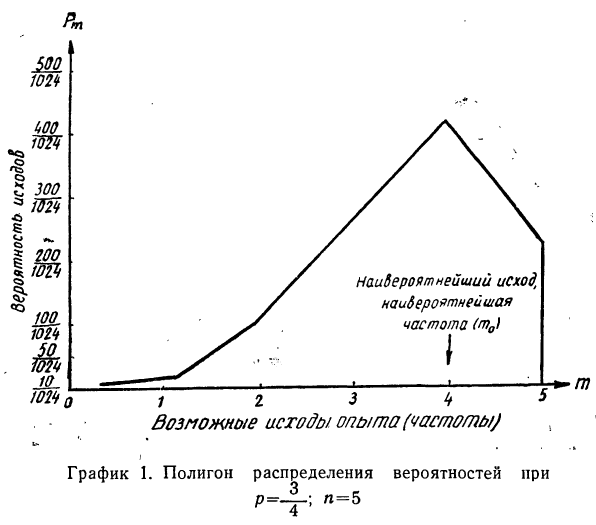

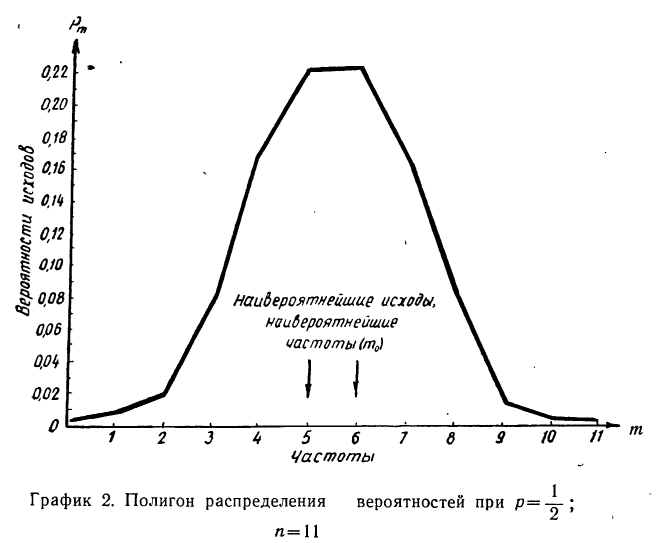

Полигон распределения вероятностей

Каждый возможный исход событий обладает определенной вероятностью.

Если на оси абсцисс наносить возможные исходы событий, а на оси ординат — вероятности этих исходов, то ломаная линия, характеризующая изменение вероятностей различных исходов событий при повторных испытаниях, называется полигоном (многоугольником) распределения вероятностей (см. раздел I, § 11).

Пример 18. По результатам разложения в биномиальную строку из примера 14 построить полигон распределения вероятностей.

В системе координат строим полигон.

Обычно при построении полигона распределения вероятностей используют формулу общего члена (разложение бинома в строку). Придавая m различные значения от 0 до n, получают вероятности

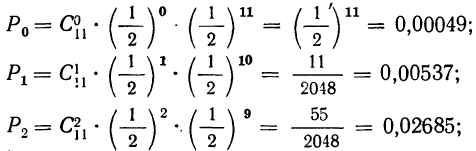

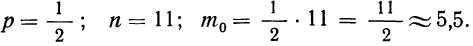

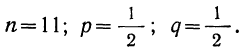

Пример 19. Дано

Находим вероятности различных исходов (частот) по формуле

Наносим полученные данные на график (см. график 2).

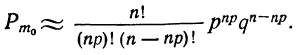

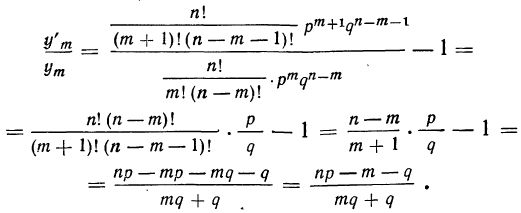

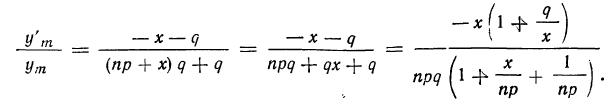

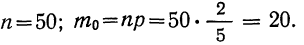

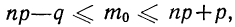

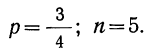

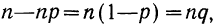

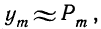

Наивероятнейшая частота

По полигонам распределения вероятностей наглядно видно, что частоты обладают различными вероятностями. Одни частоты менее вероятны, другие более вероятны. Имеется частота, обладающая наибольшей вероятностью (иногда две частоты с одинаковыми наибольшими вероятностями). Такая частота называется наивероятнейшей частотой, или наивероятнейшим исходом, обозначается

где п — число испытаний;

р — вероятность события А при одном испытании;

1.

2. Если границы неравенства (левая и правая) — целые числа, то, следовательно, имеются две наивероятнейшие частоты.

3. Если границы неравенства (левая и правая) — дроби, то между ними выбирают целое число, которое и будет наивероятнейшей частотой. Таким образом,

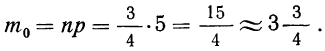

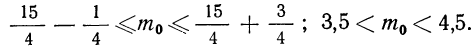

Пример 20. По данным примеров 14 и 6 при отборе 5 деталей определить наивероятнейший исход.

Имеем:

Следовательно:

По формуле наивероятнейшей частоты получаем:

Границы (левая и правая) есть дроби 3,5 и 4,5.

Целым числом между ними является 4. Следовательно,

По графику 1, где частота (m), равная 4, обладает наибольшей вероятностью, убеждаемся в совпадении результатов.

Пример 21. По данным примера 19 определить наивероятнейшую частоту.

По рассматриваемой формуле получаем:

Границы (левая и права) — целые числа. Следовательно, имеем две наивероятнейшие частоты: 5 и 6. По графику 2, где частоты 5 и 6 обладают равными наибольшими вероятностями, убеждаемся в совпадении их вероятностей.

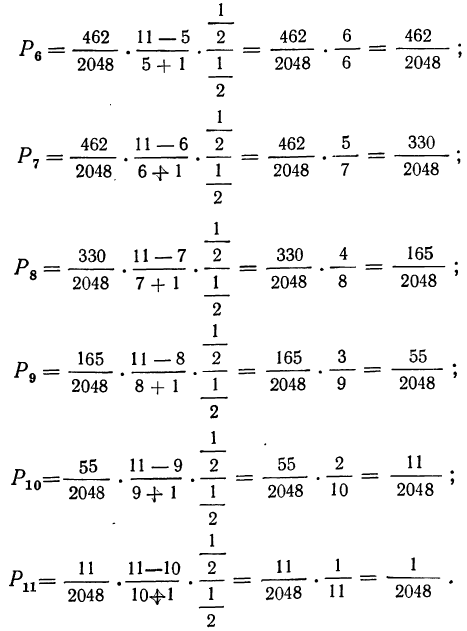

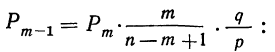

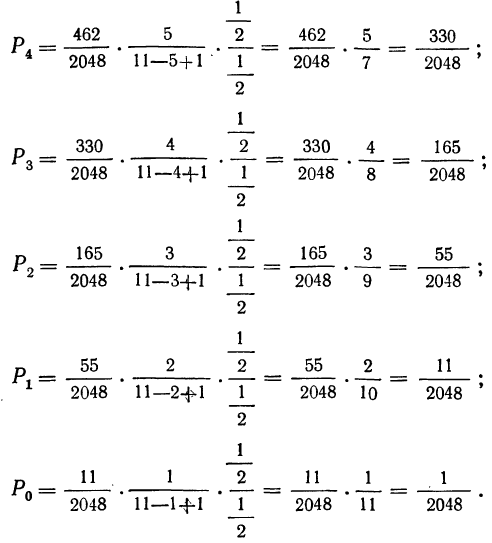

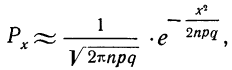

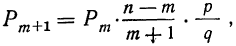

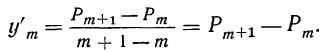

§ 26. Для расчета вероятностей всех исходов вместо разложения в биномиальную строку можно воспользоваться одной из следующих формул:

Пример 22. На основе данных примера 19 рассчитать вероятности всех частот по вышеприведенным формулам. Предварительно нужно найти вероятность какой-нибудь одной частоты. Пусть мы нашли вероятность частоты 5 по формуле:

Используя формулу

Используем формулу

Как видим, вероятности всех частот совпадают с результатами, полученными в примере 19.

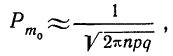

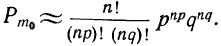

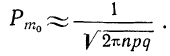

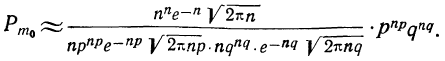

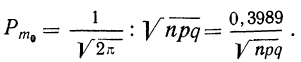

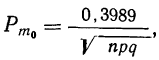

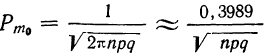

Вероятность наивероятнейшей частоты

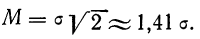

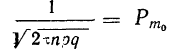

Для расчета вероятности наивероятнейшей частоты используется формула,, дающая приближенный результат. Точность формулы зависит от числа испытаний (n) и по мере увеличения числа испытаний возрастает.

где

Доказательство. Возьмем выражение

и найдем вероятность наивероятнейшей частоты, т. е.

Тогда

Зная, что

Используем формулу Стирлинга (см. § 21):

Произведя сокращения, получим:

Для расчетов используют эту формулу в несколько измененном виде:

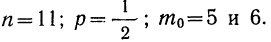

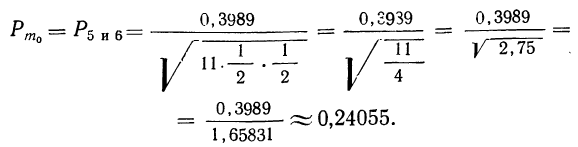

Пример 23. В примерах 20 и 21 найдены наивероятнейшие частоты. Вычислить приближенно их вероятности.

Из примера 20 имеем:

Подставляя эти значения в формулу

Из примера 21 имеем:

Сопоставляя приближенные результаты вероятностей наивероятнейших исходов, полученные в данном примере, с точными, полученными в примерах 14 и 19, видим их несомненную близость.

В примере 14

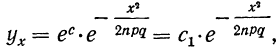

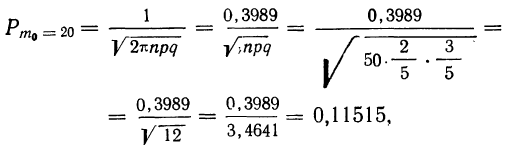

Локальная формула Лапласа

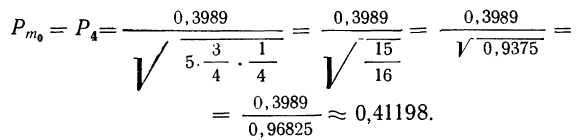

Для приближенного вычисления вероятностей биномиального распределения используется формула, которую часто называют локальной формулой Лапласа:

где х — отклонение частоты от наивероятнейшей частоты пр, т. е. х=m—nр;

е—неперово число, основание натуральных логарифмов, приближенно равное 2,71828;

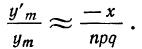

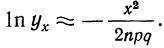

Обозначая искомую функцию

Найдем производную функции

Тогда отношение

Подставляя формулу

Вводим новую переменную х = m—nр, т. е. отклонение частоты от наивероятнейшей частоты, тогда

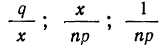

Полагая n величиной весьма большой, а р и q правильными дробями, заметно отличающимися от нуля, можнo положить равным нулю следующие величины:

Решая дифференциальное уравнение, получаем:

Откуда

где постоянная величина

Заменяя

имеем:

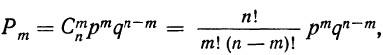

П р и м е р 24. Из партии, в которой доля деталей I сорта равна

Дано:

Мы должны найти вероятность частоты 25

По формуле

а по локальной формуле Лапласа получаем вероятность того, что частота отклонится от наивероятнейшей частоты на 5

Для нахождения второго множителя обратимся к таблице (см. приложение X), из которой приближенно найдем:

Тогда получаем:

Характерно, что и вероятность частоты 15 будет такой же. В формулу Лапласа х входит возведенным в квадрат, а поэтому значения + х и —х приводят по этой формуле к одинаковой вероятности:

Так, если мы ищем вероятность частоты 15, то х = 15—20 =—5, а поэтому

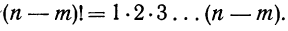

Для вычислений по локальной формуле Лапласа в ней производят замену:

Имеются таблицы значений:

(см. приложение II). Следовательно:

Придавая m различные значения, определяем сначала t по формуле

Пример 25. На основе данных примера 24 определить искомую вероятность, пользуясь указанной формулой.

Находим t по формуле

По приложению II определяем:

По формуле

Расхождение с результатом в примере 24 в 0,0001 получилось за счет неточно взятого t.

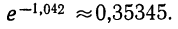

Стандартизованное распределение вероятностей

Локальной формулы Лапласа можно получить формулу, выражающую стандартизованное распределение вероятностей.

Мы знаем, что множитель

есть вероятность наивероятнейшей частоты

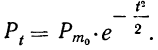

Используя приложение X, в котором даны значения е в различных степенях, можно по последней формуле построить таблицу стандартизованного распределения вероятностей (см. табл. 7).

По полученным в таблице показателям строят график стандартизованного распределения вероятностей. На оси абсцисс наносят значения t и х. На оси ординат откладывают найденные вероятности

Графическое изображение стандартизованного распределения вероятностей называется нормальной кривой, или кривой Гаусса—Лапласа (способы ее построения см. раздел IV).

Особенности данной кривой:

По мере удаления t от 0 в обе стороны вероятности уменьшаются. Это означает, что более вероятными являются частоты, примыкающие к наивероятнейшей частоте.

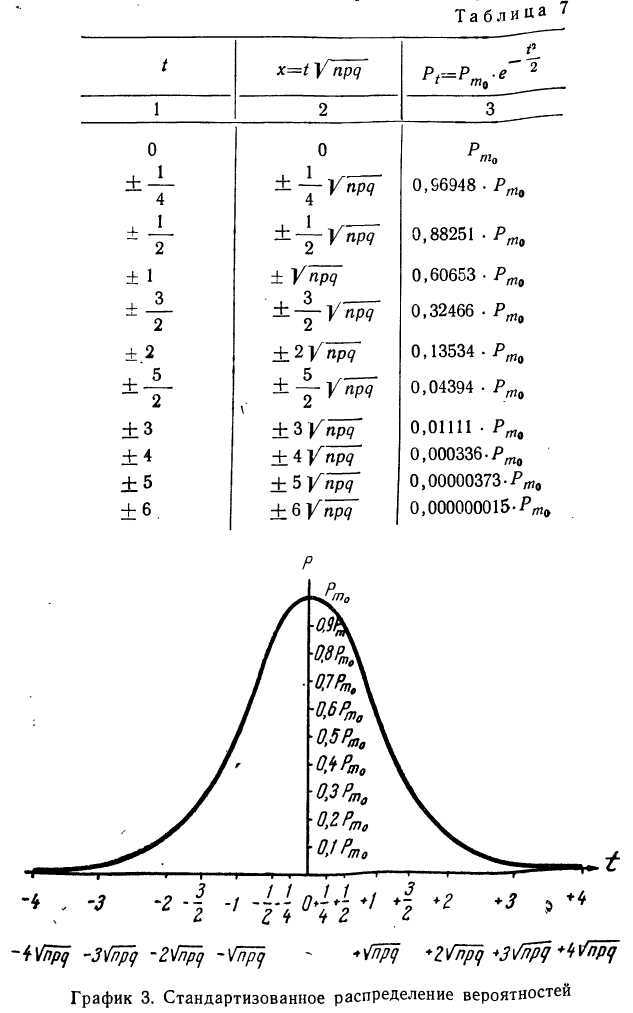

Для приближенного исчисления вероятностей по схеме «невозвращенного шара» (бесповторный отбор, при котором отобранная единица в совокупность не возвращается) можно воспользоваться несколько иной формулой:

где N — численность совокупности, из которой производится отбор.

Если n по сравнению с N — величина незначительная, то эта формула сводится к локальной формуле Лапласа.

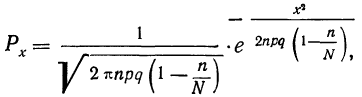

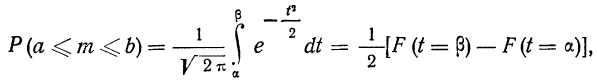

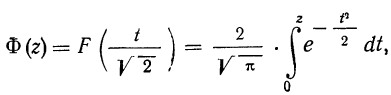

Интегральная формула Лапласа

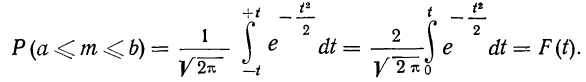

Если необходимо рассчитать вероятность того, что при п испытаниях число осуществлений события А будет находиться в заданных границах а и b, используют интегральную формулу Лапласа:

где а и b — заданные границы, числа осуществлений события А;

а и

В приложении III даны значения F(t), по которым можно определять искомое значение вероятности.

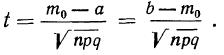

Числа а и b связаны с границами интегрирования определенным соотношением:

(Практическое применение этой связи см. в примере 26—второй вопрос.)

Если заданные границы числа осуществлений события А (а и b) отличаются от nр на одинаковую величину t, то интегральная формула Лапласа примет вид:

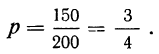

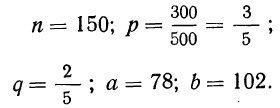

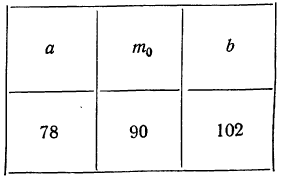

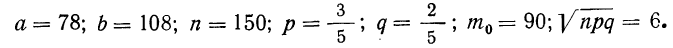

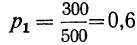

Пример 26. Из партии в 500 деталей, в которой первосортных 300, отбирается наудачу 150 деталей с возвратом. Какова вероятность того, что число деталей I сорта будет находиться в пределах: 1) от 78 до 102? 2) от 78 до 108?

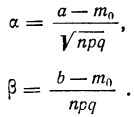

Для первого вопроса дано:

Находим:

Границы а и b отличаются от

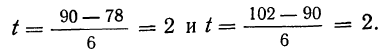

Находим t из соотношений

Получаем:

Для использования таблицы приложения III берем t = 2.

По таблице приложения III находим F(2) =0,9545.

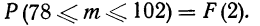

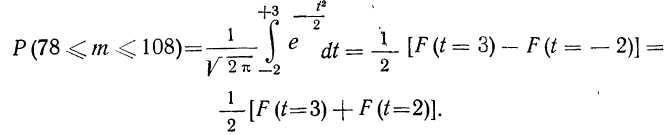

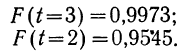

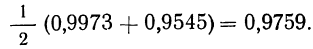

Для второго вопроса ищем вероятность того, что частота лежит в границах от 78 до 108.

Находим

Получаем:

По интегральной формуле Лапласа:

По приложению III находим:

Значит, вероятность того, что число деталей I сорта находится в границах от 78 до 108, равна 0,9759.

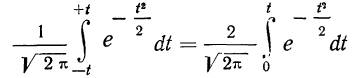

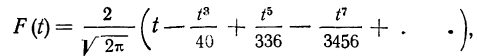

Интеграл вероятностей

Использованный в предыдущем параграфе интеграл

называется интегралом вероятностей от —t до +t и обозначается F(t).

Этот интеграл в общем виде не берется. Поэтому его можно вычислить путем разложения в ряд Маклорена:

а затем подстановкой различных значений t получают F(t). Функция F(t) является нечетной, т. е. F(—t) =—F(t). При изменении t от 0 до

С геометрической точки зрения F(t) представляет площадь, заключенную между кривой вероятностей, осью абсцисс и соответствующими ординатами. Интеграл вероятностей широко используется в расчетах, связанных с применением выборочного метода, в следующих случаях: 1) при оценке результатов выборки с определенной вероятностью; 2) при определении наименьшей численности выборки, обеспечивающей необходимую точность; 3) при определении границ отклонений генеральной средней от выборочной.

Применяется несколько видов таблиц интеграла вероятностей:

1) Таблица Маркова дает значения интеграла вероятностей:

представляющего собой площадь, ограниченную кривой вероятностей, осью абсцисс и двумя ординатами, расположенными на расстоянии z, выраженном в единицах модуля вероятностей.

2) Таблица Шеппарда строится по формуле

и дает значения интеграла вероятностей на протяжении от —

3) Из таблицы Шеппарда можно составить таблицу значений интеграла вероятностей F(t), используя формулу F(t) = = 2Ф(z) — 1.

Существуют и другие виды таблиц интеграла вероятностей.

Случайные величины

Величина х, принимающая в зависимости от некоторых случайных обстоятельств одно из значений

Случайные величины бывают дискретными (с дискретным рядом возможных значений) и непрерывными (имеющие сколь угодно близкие возможные значения). Совокупность значений случайных величин и соответствующих вероятностей называют распределением случайной величины.

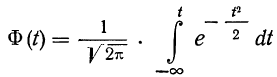

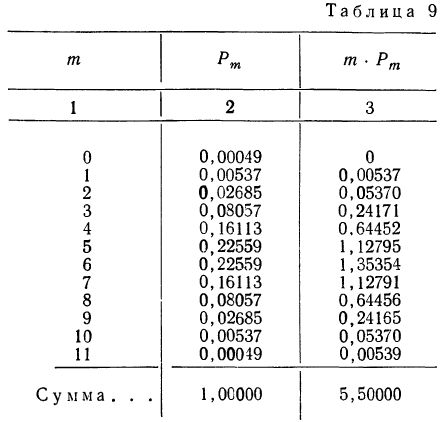

Пример 27. Если производится отбор 11 деталей из партии, в которой вероятность первосортной детали равна

Здесь совокупность m и

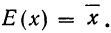

Математическое ожидание дискретной случайной величины равно сумме произведений каждого возможного значения этой величины на его вероятность

где Е— символ математического ожидания;

Такая средняя называется стохастической.

П р и м е р 28. На основе данных примера 19 ищем математическое ожидание случайной величины.

Применим формулу:

Располагаем полученные данные в таблицу и вычисляем произведения частот на их вероятности.

Получаем по формуле математического ожидания:

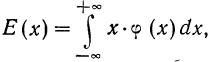

Математическое ожидание непрерывной случайной величины исчисляется по формуле:

где

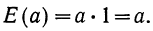

Свойства математического ожидания:

а) Математическое ожидание постоянной величины равно этой постоянной:

Доказательство. Постоянную величину а можно рассматривать как случайную величину, принимающую только одно значение а, с вероятностью, равной единице:

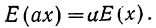

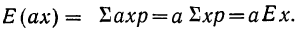

б) Постоянный множитель выносится за знак математического ожидания:

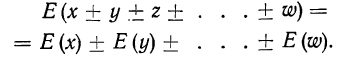

в) Математическое ожидание алгебраической суммы случайных величин равно алгебраической сумме их математических ожиданий:

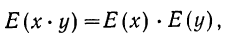

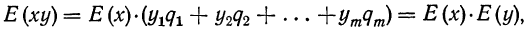

г) Математическое ожидание произведения независимых случайных величин равно произведению их математических ожиданий:

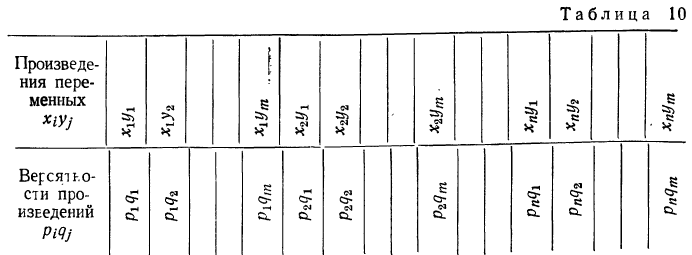

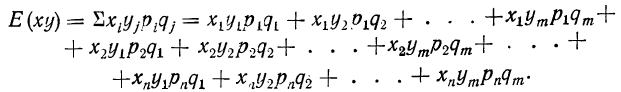

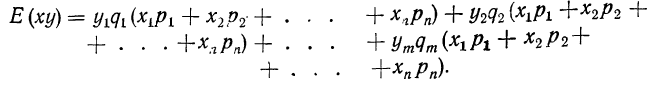

Доказательство. Имеются две независимые случайные величины х и у со значениями:

Получаем

Найдем математическое ожидание произведения:

Сгруппируем члены, содержащие

Учитывая, что выражение, стоящее в скобках, есть

д) Математическое ожидание случайной величины, принимающей только два значения: 1 — при осуществлении некоторого события и 0 — при его неосуществлении, равно вероятности события:

Пример 29. В партии 500 деталей, из них I сорта 300. Производится отбор одной детали. Найти математическое ожидание числа деталей I сорта.

Имеем два варианта: 1 и 0.

Найдем вероятности вариантов:

и видим, что математическое ожидание данной случайной величины равно вероятности первого варианта.

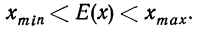

е) ^Математическое ожидание случайной величины всегда заключено между наименьшим и наибольшим ее значением:

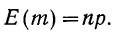

ж) Математическое ожидание частоты при биномиальном распределении равно произведению числа испытаний на вероятность события:

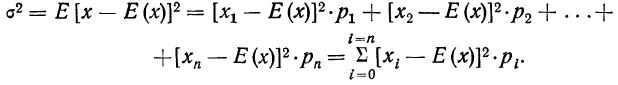

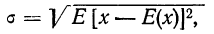

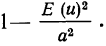

Математическое ожидание квадрата отклонения случайной величины от ее математического ожидания называется стохастической дисперсией (обозначается

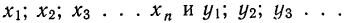

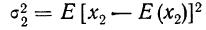

Если имеется несколько независимых случайных величин

Найдем: 1) стохастическую дисперсию каждой случайной величины, измеряющую отклонения значений случайной величины ст ее математического ожидания.

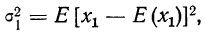

Стохастическая дисперсия первой случайной величины:

второй случайной величины:

и т. д., а в общем виде

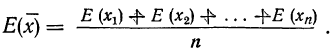

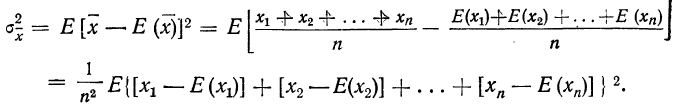

2) стохастическую дисперсию, измеряющую отклонения общей средней от своего математического ожидания:

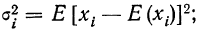

Возводим в квадрат отклонения и учитываем, что ввиду независимости случайных величин математическое ожидание произведения отклонений двух случайных величин равно нулю, т. е.

Поэтому, исключая удвоенные попарные произведения, получаем:

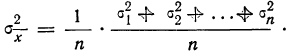

Полагая, что второй множитель равен средней из дисперсий случайных величин, записываем

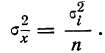

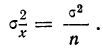

Следовательно, стохастическая дисперсия средней в п раз меньше стохастической дисперсии каждой случайной величины.

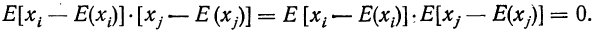

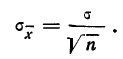

Среднее квадратическое отклонение

и следовательно:

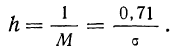

В качестве меры рассеяния может быть использован модуль вероятностей, обозначаемый М и вычисляемый по формуле:

Иногда для характеристики рассеяния нормальной кривой применяют меру точности, обозначаемую h и представляющую собой величину, обратную модулю вероятностей:

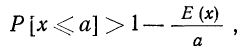

Лемма Маркова

Если имеем k вариантов случайной величины, могущей принять одно из положительных значений

Можно лемму Маркова записать и так:

если принять

Следствие леммы Маркова.

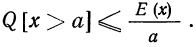

Вероятность того, что

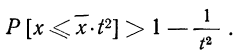

Первое неравенство Чебышева

Из леммы Маркова вытекает неравенство, называемое первым неравенством Чебышева. Если случайная величина u принимает положительные и отрицательные значения и если a — произвольная величина, то вероятность того, что случайная величина и будет находиться в границах между —а и +а, т. е. вероятность неравенства

больше

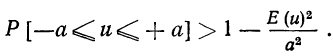

Следствие первого неравенства Чебышева

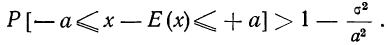

Возьмем вместо случайной величины и другую случайную величину х—Е(х), тогда первое неравенство Чебышева примет вид:

и, заменяя

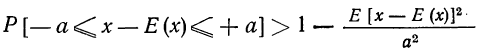

Второе неравенство Чебышева

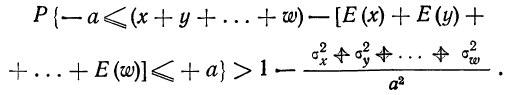

Если вместо случайной величины u из первого неравенства Чебышева взять другую случайную величину

Если при этом величины

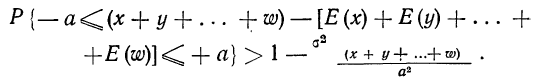

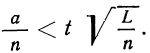

Теорема Чебышева

Второе неравенство Чебышева может быть записано иначе.

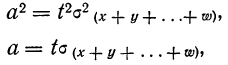

то в правой части заключительной формулы предыдущего параграфа получим:

Но если все

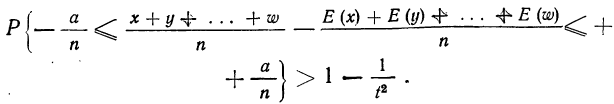

где

Эта формула выражает знаменитую теорему Чебышева и читается так: с вероятностью, сколь угодно близкой к единице (достоверности), можно утверждать, что если

Теорема Чебышева в весьма общем виде выражает закон больших чисел, суть которого состоит в том, что совокупные действия большого числа случайных факторов приводят к результату, почти не зависящему от случая.

Следствие теоремы Чебышева

Если

Чтобы убедиться в этом, достаточно учесть, что в этом случае

При копировании любых материалов с сайта evkova.org обязательна активная ссылка на сайт www.evkova.org

Сайт создан коллективом преподавателей на некоммерческой основе для дополнительного образования молодежи

Сайт пишется, поддерживается и управляется коллективом преподавателей

Whatsapp и логотип whatsapp являются товарными знаками корпорации WhatsApp LLC.

Cайт носит информационный характер и ни при каких условиях не является публичной офертой, которая определяется положениями статьи 437 Гражданского кодекса РФ. Анна Евкова не оказывает никаких услуг.